現在のAI技術を支えている「ディープラーニング(深層学習)」は、画像認識や自然言語処理、生成AIなど幅広い分野で活用されています。

その基礎となっているのが、**パーセプトロン(Perceptron)**です。

パーセプトロンは、人間の脳の神経細胞(ニューロン)の働きを参考に作られた数理モデルであり、現代ニューラルネットワークの原点ともいえる存在です。

1950年代に提案された比較的古い技術ですが、その思想は現在のDNN(ディープニューラルネットワーク)にも受け継がれています。

この記事では、パーセプトロンの基本概念から仕組み、単純パーセプトロンと多層パーセプトロンの違い、歴史、限界、現代AIとの関係まで分かりやすく解説します。

パーセプトロンとは

パーセプトロンとは、人間の脳のニューロン構造を模した人工ニューロンモデルです。

簡単に言えば、

入力された情報からパターンを学習し、判断する仕組みです。

現在のAIにおけるニューラルネットワークの基本構造でもあります。

パーセプトロンの元になった「ニューロン」

人間の脳には「ニューロン(神経細胞)」と呼ばれる細胞があります。

ニューロン同士はネットワーク状につながっており、

- 記憶

- 学習

- 認識

- 運動制御

などを行っています。

脳の仕組みをコンピュータで再現する

パーセプトロンは、このニューロンの働きを数式化したものです。

つまり、

脳の情報処理を人工的に再現することを目的としていました。

パーセプトロンの歴史

パーセプトロンは1957年に、アメリカの情報科学者である Frank Rosenblatt によって提案されました。

当時は「機械が学習できる」という考え自体が革新的でした。

Mark I Perceptron

1958年には、「Mark I Perceptron」という専用ハードウェアも試作されました。

これは現在のAI専用チップやGPUの先駆けともいえる存在です。

パーセプトロンの基本構造

パーセプトロンは主に以下で構成されます。

- 入力層

- 重み

- 出力層

入力層とは

入力層は、外部からデータを受け取る部分です。

例えば画像認識なら、

- 明るさ

- 色

- 形状

などの特徴が入力されます。

重み(Weight)とは

入力値には「重み(Weight)」が設定されます。

重みとは、

どの情報をどれだけ重要視するかを表す値です。

例えば、

- 猫判定で「耳」が重要

- 「背景」は重要ではない

といった重要度を学習します。

重み付き和の計算

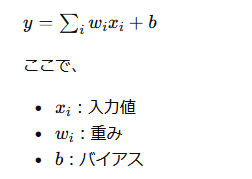

パーセプトロンでは、入力値と重みを掛け合わせて合計します。

基本式は次の通りです。

を表しています。

出力層とは

計算結果をもとに、最終的な判断を出力します。

例えば、

猫 or 犬のような分類を行います。

パーセプトロンの学習方法

パーセプトロンは、正解データを使って学習します。

学習の流れ

基本的な流れは次の通りです。

- 入力データを与える

- 出力結果を計算する

- 正解と比較する

- 間違いに応じて重みを修正する

重み更新の考え方

例えば、

- 正解に貢献した特徴 → 重みを強化

- 間違いの原因 → 重みを弱化

します。

この繰り返しによって、徐々に精度が向上します。

単純パーセプトロンとは

初期のパーセプトロンは、

- 入力層

- 出力層

だけを持つシンプル構造でした。

これを「単純パーセプトロン(Single-layer Perceptron)」と呼びます。

単純パーセプトロンの限界

単純パーセプトロンには大きな問題がありました。

それが、

線形分離しかできないという点です。

線形分離とは

線形分離とは、

直線で分類できるデータのことです。

例えば、

- 単純な二値分類

なら可能です。

しかし、

- XOR問題

- 複雑な画像認識

などは解けません。

XOR問題とは

XOR問題は、単純パーセプトロンの限界を示した有名な例です。

XORでは、

入力が異なるときだけ1を出力します。

これは1本の直線では分類できません。

そのため、単純パーセプトロンでは解決不可能でした。

多層パーセプトロン(MLP)とは

この問題を解決するために登場したのが、多層パーセプトロン(MLP:Multi-Layer Perceptron)です。

隠れ層を追加する

多層パーセプトロンでは、

- 入力層

- 隠れ層

- 出力層

を持ちます。

隠れ層とは

隠れ層は、入力と出力の間で特徴変換を行う部分です。

これによって、

- 非線形問題

- 複雑パターン

- 高度な特徴抽出

が可能になります。

ディープニューラルネットワーク(DNN)との関係

隠れ層をさらに増やしたものが、現在のDNN(Deep Neural Network)です。

例えば、

入力層

↓

隠れ層1

↓

隠れ層2

↓

隠れ層3

↓

出力層のような深い構造になります。

なぜディープラーニングが成功したのか

かつては、多層ネットワークの学習が非常に困難でした。

理由として、

- 計算能力不足

- データ不足

- 学習アルゴリズム未成熟

などがあります。

誤差逆伝播法(バックプロパゲーション)

1990年代以降、「バックプロパゲーション(誤差逆伝播法)」が普及しました。

これによって、深いネットワークでも効率的に学習できるようになりました。

GPU進化も大きい

さらに、

- GPU

- 大規模データ

- 深層学習フレームワーク

の進化によって、現在のAIブームが実現しました。

パーセプトロンの現代的意義

現在では、単純パーセプトロン単体が使われる場面は多くありません。

しかし、

ニューラルネットワークの原点として非常に重要です。

現在の、

- CNN

- RNN

- Transformer

- 生成AI

も、基本的には「ニューロンと重み」の考え方を継承しています。

パーセプトロンのメリット

シンプルで理解しやすい

ニューラルネットワーク入門に最適です。

学習の基本原理を理解できる

重み更新や分類の基礎を学べます。

パーセプトロンのデメリット

単純モデルでは表現力が低い

複雑問題には対応できません。

線形分離問題しか解けない

単層構造には限界があります。

まとめ

パーセプトロン(Perceptron)は、人間の脳のニューロン構造を模したニューラルネットワークの原型です。

現在の深層学習や生成AIも、このパーセプトロンの考え方を基礎として発展しています。

ポイントを整理すると、以下の通りです。

- ニューロンを模した人工モデル

- 重み付き和によって判断する

- 単純パーセプトロンは線形分離のみ可能

- 多層化によって高度な学習が可能になった

- 現代DNNの基礎技術である

パーセプトロンを理解することは、AI・ディープラーニング全体の理解につながる重要な第一歩です。

こちらもご覧ください:VQ-VAEとは?仕組み・VAEとの違い・コードブック・生成AIへの応用をわかりやすく解説