生成AIの発展によって、「画像や音声をどのように効率よく表現するか」が重要な研究テーマになっています。その中で注目されている技術の一つが、**VQ-VAE(Vector Quantized Variational Autoencoder)**です。

VQ-VAEは、通常のVAE(変分オートエンコーダ)とは異なり、データを「離散的な記号」として表現する特徴を持っています。

この仕組みにより、

- 高精細な画像生成

- 音声生成

- Transformerとの連携

- 効率的な特徴圧縮

などが可能になりました。

近年の生成AI技術にも大きな影響を与えている重要モデルです。

この記事では、VQ-VAEの基本構造や仕組み、通常VAEとの違い、コードブックの役割、Transformerとの関係まで、初心者にも分かりやすく解説します。

VQ-VAEとは

VQ-VAE(Vector Quantized Variational Autoencoder)は、VAEを拡張した生成モデルです。

最大の特徴は、

潜在表現を離散化する点にあります。

通常のVAEでは、潜在空間は連続値で表現されます。

一方VQ-VAEでは、「コードブック」と呼ばれる有限個のベクトル集合を利用し、入力データを離散的な記号へ変換します。

まずはVAEを簡単に理解しよう

VQ-VAEはVAEを発展させたモデルです。

まず通常VAEを簡単に整理しておきます。

VAE(変分オートエンコーダ)とは

VAEは、

- 入力データを潜在空間へ圧縮

- 潜在変数からデータを復元

する生成モデルです。

例えば画像の場合、

画像 → 潜在分布 → 画像生成という流れになります。

従来VAEの課題

通常VAEには重要な課題があります。

それが、

生成画像がぼやけやすいという問題です。

なぜぼやけるのか

VAEでは潜在空間が連続値として表現されます。

そのため、平均化された特徴が生成されやすく、細部が失われる場合があります。

特に高解像度画像では、

- 輪郭が曖昧

- 細部が不鮮明

になりやすい傾向があります。

VQ-VAEの核心:「量子化」

VQ-VAEでは、この問題を改善するために「量子化(Quantization)」を導入しています。

コードブックとは

VQ-VAEでは、「コードブック(Codebook)」と呼ばれるベクトル辞書を持ちます。

例えば、

コード1

コード2

コード3

...のような有限個の特徴ベクトルが登録されています。

エンコーダの役割

エンコーダは入力データを特徴ベクトルへ変換します。

その後、

最も近いコードブックベクトルを選択します。

離散表現とは

通常VAEでは連続値を扱います。

一方VQ-VAEでは、

ベクトル番号(インデックス)としてデータを表現します。

つまり、

- 「コード12」

- 「コード85」

- 「コード103」

のような離散記号列へ変換されます。

パズルのようなイメージ

VQ-VAEはよく、

画像を有限パターンの組み合わせで表現すると説明されます。

これはパズルに似ています。

具体例

例えば画像を、

- 目パーツ

- 鼻パーツ

- 輪郭パーツ

などの有限パターンへ分解するイメージです。

コードブックは、この「視覚的語彙」を学習していきます。

VQ-VAEの基本構造

VQ-VAEは主に以下で構成されます。

- エンコーダ

- コードブック

- デコーダ

エンコーダ

入力データから特徴量を抽出します。

ベクトル量子化

抽出特徴を最も近いコードブックベクトルへ置き換えます。

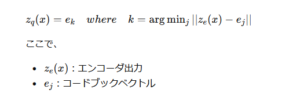

概念的には次のようになります。

を表しています。

デコーダ

選択されたコードベクトルから元データを復元します。

なぜ離散化が重要なのか

離散化には大きなメリットがあります。

情報密度が高くなる

有限個の記号へ圧縮することで、効率的な表現が可能になります。

Transformerと相性が良い

Transformerは「単語列」のような離散データ処理が得意です。

VQ-VAEによって画像を記号列化することで、Transformerへ入力しやすくなります。

VQ-VAEとTransformerの関係

近年の生成AIでは、VQ-VAEとTransformerの組み合わせが非常に重要です。

画像を「単語化」する

VQ-VAEでは画像をコード列へ変換できます。

例えば、

12, 85, 103, 7 ...のような記号列です。

これは自然言語処理における単語列に近い考え方です。

Transformerで学習する

Transformerは、このコード列の並び方を学習します。

これによって、

- 高精細画像生成

- 複雑な構造生成

- 長距離依存関係学習

が可能になります。

ストレートスルー推定法とは

VQ-VAEでは量子化処理が入るため、そのままでは微分できません。

そこで利用されるのが「ストレートスルー推定法(Straight-Through Estimator)」です。

なぜ必要なのか

ニューラルネットワークは誤差逆伝播によって学習します。

しかし量子化は離散処理なので、通常は勾配計算できません。

解決方法

VQ-VAEでは、

勾配だけはそのまま通すという近似を行います。

これにより学習が可能になります。

VQ-VAEのメリット

高品質な生成が可能

通常VAEより鮮明な画像生成が期待できます。

離散表現を学習できる

意味のある「視覚的語彙」を獲得できます。

Transformerと組み合わせやすい

現代生成AIとの相性が非常に良いです。

圧縮効率が高い

データをコンパクトな記号列へ変換できます。

VQ-VAEのデメリット

コードブック設計が難しい

コード数や次元設定が性能へ大きく影響します。

学習が不安定になる場合がある

コードブック更新が偏るケースがあります。

VQ-VAEの主な応用分野

画像生成AI

高解像度画像生成に利用されます。

音声生成

音声波形を離散表現へ変換できます。

動画生成

動画フレーム圧縮にも応用されています。

画像圧縮

効率的な特徴圧縮技術としても注目されています。

現代生成AIにおけるVQ-VAEの重要性

VQ-VAEは、

- 離散潜在表現

- Transformer連携

- 高品質生成

という点で、生成AIの重要技術になっています。

特に、

画像を「言語」のように扱うという考え方は、現在のマルチモーダルAIにも強く影響を与えています。

関連モデル

VAE

連続潜在空間を利用する基本生成モデルです。

β-VAE

特徴分離を重視したVAEです。

InfoVAE

情報保持能力を強化したVAEです。

まとめ

VQ-VAE(Vector Quantized Variational Autoencoder)は、潜在表現を離散化する生成モデルです。

コードブックを利用してデータを記号列へ変換することで、高品質生成やTransformer連携を実現しています。

ポイントを整理すると、以下の通りです。

- VAEを拡張した生成モデル

- コードブックによる離散表現を利用

- 画像のぼやけ問題を改善

- Transformerと相性が良い

- 高品質生成AIの基盤技術になっている

VQ-VAEは、現代生成AIやマルチモーダルAIを理解するうえで非常に重要な技術の一つです。

こちらもご覧ください:β-VAE(Beta-VAE)とは?VAEとの違い・特徴分離・解釈可能なAIをわかりやすく解説