汎用人工知能(AGI:Artificial General Intelligence)は、現在のAI技術の到達点をはるかに超える未来の知能モデルとして注目されています。

自ら学び、判断し、意志を持って行動するAI――それはSFの世界だけの話ではなく、多くの研究者が真剣に模索している技術的目標でもあります。

本記事では、AGIの定義、弱いAIとの違い、実現に向けた課題、そして「シンギュラリティ」と呼ばれる未来の展望について、IT技術者向けにわかりやすく解説します。

汎用人工知能(AGI)とは何か?

AGIの定義と特徴

汎用人工知能(AGI)とは、人間のように幅広い分野で思考・判断・学習ができる人工知能を指します。

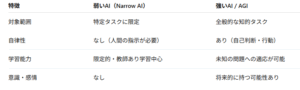

現在主流のAIは、画像認識や音声認識、自然言語処理など特定タスクに特化した「弱いAI(Narrow AI)」ですが、AGIは以下のような能力を持つとされます:

-

自律的な意思決定

-

新しい概念の学習と応用

-

長期的な目標設定と計画

-

状況に応じた創造性の発揮

-

人間のような柔軟な認知・感情処理

例:医療、法律、教育、工学など異なる分野においても人間並みに対応可能なAIがAGI

弱いAIとの違い

AGIは、単なるタスク遂行マシンではなく、人間と同等、もしくはそれ以上の“知性”を持つ存在と定義されます。

AGI実現に向けた技術的課題

課題① 統合的な認知アーキテクチャ

現行AIでは、視覚認識・音声認識・言語処理などが個別に開発されていますが、AGIにはこれらを統合的に扱う能力が必要です。

例:人間は「音声から感情を読み取り」「相手の意図を推測し」「文脈に応じて反応」を自然に行う

こうした能力を実現するためには、高度な推論エンジンと知識表現手法(Semantic Web, Knowledge Graph等)の進化が求められます。

課題② 自律性と意識の再現

AGIは、単なるデータ処理装置ではなく、「なぜ行動するのか?」という意志や目的意識を持つ必要があります。

-

強化学習だけでは不十分

-

感情や価値観のような動機形成メカニズムのモデル化が不可欠

-

意識の定義や再現方法については哲学・神経科学との連携も必要

課題③ 倫理とセーフガード

AGIが実現すれば、人間社会に大きな影響を及ぼす可能性があります。

ゆえに以下のような倫理的課題が重要視されます:

-

AGIが自己複製や自律進化を始めた場合の制御方法

-

人間との価値観の違いによる対立リスク

-

利用者・企業・国家による悪用防止策

シンギュラリティとその未来像

シンギュラリティとは?

シンギュラリティ(技術的特異点)とは、AGIが自らを設計・改良することで、人間の知能を超える知性に急激に進化する転換点を指します。

-

レイ・カーツワイル氏によれば、2045年までに到来する可能性があるとされている

-

AGIが新たな科学理論・技術・経済モデルを生み出す「知的爆発」が想定される

ポジティブな未来像

-

難病の治療法や環境問題の解決

-

生産性の飛躍的向上

-

創造的な芸術や科学技術の革新

ネガティブな未来像と警鐘

-

映画『ターミネーター』に登場するスカイネットのように、人間の統制を超えたAIが敵対的存在になる可能性

-

経済・軍事における支配力の集中

-

人類の存在意義を問われる未来

これらを防ぐためには、AGIに対する法的枠組み・国際的合意・倫理規範の整備が不可欠です。

まとめ

汎用人工知能(AGI)は、AI研究の究極的な目標として多くの技術者・研究者・哲学者の関心を集めています。

-

弱いAIでは実現できない領域に挑む次世代技術

-

人間のような意識・自律性・判断力を備えるAIの可能性

-

実現には技術・倫理・社会制度の融合が必要不可欠

-

シンギュラリティによる人類の未来に備える準備が求められる

AGIはまだ実在しない技術ですが、その実現が近づくにつれ、私たちの社会・価値観・技術基盤を根本から再定義するインパクトをもたらすでしょう。

さらに参考してください:

【汎用系システムとは?】今なお企業の中枢を支えるメインフレーム系の全貌を解説