ディープラーニングでは、ニューラルネットワークを深くすることで高い表現力を実現できます。

しかし、ネットワークが深くなるほど学習が不安定になる問題も発生します。

その代表例の一つが「勾配爆発問題(Exploding Gradient Problem)」です。

勾配爆発問題が起きると、学習中の数値が急激に大きくなり、モデルの更新が暴走してしまいます。

結果として、学習が収束しなくなったり、計算エラーが発生したりする原因になります。

特にRNN(回帰型ニューラルネットワーク)や深いニューラルネットワークでは重要な課題として知られています。

本記事では、勾配爆発問題の仕組みや発生原因、勾配消失問題との違い、そして代表的な対策方法までをわかりやすく解説します。

勾配爆発問題とは?

勾配爆発問題(Exploding Gradient Problem)とは、ニューラルネットワークの学習中に勾配が異常に大きくなり、パラメータ更新が不安定になる現象です。

簡単に言えば、「誤差情報が増幅されすぎて、学習が暴走する問題」です。

そもそも勾配とは?

ニューラルネットワークでは、予測結果と正解との差を小さくするために、重み(パラメータ)を更新します。

その更新方向と更新量を決めるのが「勾配(Gradient)」です。

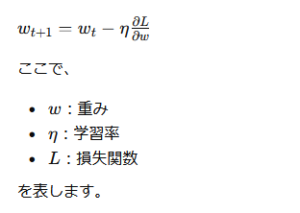

勾配降下法の基本

学習では、損失関数を小さくする方向へパラメータを更新します。

を表します。

勾配が適切な大きさであれば、少しずつ誤差を減らしながら学習できます。

誤差逆伝播法(バックプロパゲーション)との関係

ニューラルネットワークでは、誤差逆伝播法(Backpropagation)によって勾配を計算します。

出力層で生じた誤差を、入力層方向へ逆向きに伝えていく仕組みです。

なぜ勾配爆発が起きるのか?

問題は、勾配が層を通過するたびに掛け算される点にあります。

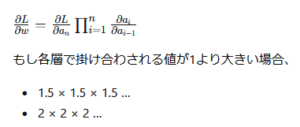

連鎖律による増幅

バックプロパゲーションでは、微分の連鎖律(Chain Rule)が使われます。

勾配は以下のように複数の微分値を掛け合わせながら伝播します。

のように、勾配が指数関数的に増大します。

深いネットワークほど危険

層数が多いほど掛け算回数が増えるため、勾配爆発は深層ネットワークで起こりやすくなります。

特に長い系列を扱うRNNでは顕著です。

勾配爆発問題が引き起こす問題

学習が不安定になる

重み更新が極端に大きくなることで、最適解を飛び越えてしまいます。

その結果、

- 損失が急激に増える

- 学習が振動する

- 収束しない

といった問題が発生します。

数値オーバーフロー

極端な場合、数値がコンピュータで扱える範囲を超えてしまいます。

すると、

- NaN(Not a Number)

- Inf(無限大)

などが発生し、学習が停止することがあります。

モデル性能の低下

勾配が不安定になることで、正しい特徴学習ができなくなります。

勾配消失問題との違い

勾配爆発問題と対になる問題が「勾配消失問題」です。

| 問題 | 状態 |

|---|---|

| 勾配消失 | 勾配が小さくなりすぎる |

| 勾配爆発 | 勾配が大きくなりすぎる |

どちらも深層学習における重大な課題です。

特にRNNで発生しやすい理由

RNN(回帰型ニューラルネットワーク)は、時系列データを扱うモデルです。

文章や音声のような長い系列を処理する際、同じ重みを繰り返し利用します。

この構造によって、

- 勾配消失

- 勾配爆発

の両方が発生しやすくなります。

勾配爆発問題の主な対策

現在のディープラーニングでは、複数の対策が利用されています。

勾配クリッピング(Gradient Clipping)

最も代表的な対策が「勾配クリッピング」です。

勾配クリッピングとは?

勾配が一定値を超えた場合、強制的に小さくする手法です。

例えば、

- 最大値を設定

- ノルムを制限

などを行います。

イメージ

通常の更新:

- 勾配 = 1000

→ 更新量が巨大

クリッピング後:

- 勾配 = 5

→ 安定した更新

メリット

勾配クリッピングにより、

- 学習の暴走防止

- 数値安定性向上

- RNN学習の安定化

が期待できます。

現在では多くの深層学習フレームワークで標準的に使われています。

適切な重み初期化

初期値設定も非常に重要です。

代表例として、

- Xavier初期化

- He初期化

があります。

適切な初期化により、勾配の極端な増大を防ぎます。

活性化関数の工夫

古い活性化関数では勾配が不安定になりやすい場合があります。

現在では、

- ReLU

- Leaky ReLU

- GELU

などが広く利用されています。

ReLU関数

![]()

ReLU系関数は計算が単純で、深層学習に適しています。

LSTM・GRUによる対策

RNN系では、

- LSTM

- GRU

などの「ゲート構造」を持つモデルが開発されました。

これにより、

- 長期依存関係

- 勾配安定化

が大きく改善されました。

Batch Normalizationの利用

Batch Normalizationは各層のデータ分布を安定化する技術です。

これによって勾配の極端な変化を抑え、学習を安定化できます。

Transformer時代でも重要

現在主流のTransformerでも、勾配安定化は重要です。

Transformerでは、

- Residual Connection

- Layer Normalization

- 適切な初期化

などによって勾配問題を抑えています。

ChatGPTのような大規模言語モデル(LLM)でも欠かせない技術です。

実務で見られる勾配爆発のサイン

実際の学習では、以下のような現象が起きた場合、勾配爆発が疑われます。

- lossが突然巨大化する

- lossがNaNになる

- 学習が急停止する

- パラメータ値が異常に大きくなる

こうした場合は、

- 学習率を下げる

- 勾配クリッピングを導入する

などの対応が有効です。

まとめ

勾配爆発問題(Exploding Gradient Problem)とは、バックプロパゲーション中に勾配が指数関数的に増大し、学習が不安定になる現象です。

特に、

- 深いニューラルネットワーク

- RNN

- 長い時系列データ

で発生しやすい特徴があります。

現在では、

- 勾配クリッピング

- 適切な初期化

- ReLU系活性化関数

- Batch Normalization

- LSTM・GRU

などの技術によって改善されています。

勾配爆発問題の理解は、現代AIの学習メカニズムを理解するうえで非常に重要であり、大規模言語モデルや生成AIの基盤技術にも深く関わっています。

こちらもご覧ください:勾配消失問題とは?ディープラーニング学習を妨げる重要課題をわかりやすく解説