決定木(Decision Tree)は、意思決定や分類、予測を行うための強力なツールです。

この記事では、決定木の基本概念から実際の応用、そしてその利点と限界について詳しく解説します。

データ分析や機械学習の分野で決定木がどのように役立つのかを理解し、効果的に活用するための知識を深めましょう。

決定木の基本概念

決定木とは

決定木とは、木構造(ツリー構造)を用いてデータを分類したり、予測を行ったりする手法です。

基本的には、以下の要素で構成されています。

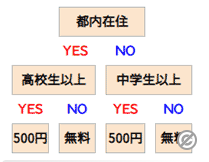

- ルートノード: 木の最上部に位置し、最初の条件を示します。

- ノード(枝分かれ): 各ノードには条件が設定されており、データに基づいて分岐します。

- リーフノード(末端): 分岐の結果、最終的な結論や予測結果が示されます。

この構造を用いることで、複雑な意思決定プロセスを段階的に整理し、理解しやすい形で表現することができます。

決定木の分類と回帰

- 分類木(Classification Tree): データをカテゴリに分類するための決定木。

- 例えば、スパムメールと非スパムメールを区別するために使用されます。

- 回帰木(Regression Tree): 数値データの予測や関数の近似を行うための決定木。

- 例えば、住宅価格の予測などに用いられます。

決定木の利点と応用

利点

- 非線形データの扱いやすさ: 決定木は非線形な関係を扱うのに優れており、多様なデータに対応できます。

- 説明の容易さ: 決定木の結果は視覚的に理解しやすく、なぜその結論に至ったのかを説明しやすいです。

- 外れ値の影響が小さい: 決定木は外れ値に対して比較的ロバストです。

応用例

- 医療診断: 患者の症状や検査結果に基づいて疾患を診断するためのツールとして利用されます。

- 顧客分類: 顧客の購入履歴に基づいてターゲットマーケティングを行うためのモデルとして使用されます。

決定木の課題と対策

課題

- 過学習のリスク: 決定木はデータに対して過学習しやすく、訓練データに特化しすぎる可能性があります。

- 線形データへの不適性: 線形な関係が強いデータには適さない場合があります。

- 性能の限界: 他のモデルに比べて分類性能が劣ることが多いです。

対策

- 剪定(Pruning): 過学習を防ぐために、決定木の枝を剪定することで、モデルを簡素化します。

- アンサンブル法の利用: 複数の決定木を組み合わせたランダムフォレストや勾配ブースティングなどのアンサンブル法を用いることで、性能を向上させることができます。

まとめ

決定木は、その直感的な構造と視覚的な理解のしやすさから、意思決定や分類、予測において非常に有用なツールです。

データの複雑さや種類に応じて適切に活用することで、強力な分析手法を提供します。

しかし、過学習や性能の限界といった課題もあるため、これらの点に留意しつつ、他の手法と組み合わせて最適な結果を得ることが重要です。

さらに参考してください。

デシジョンテーブル(Decision Table)とは?システム開発からテストまでの活用法

Visited 17 times, 1 visit(s) today