機械学習やディープラーニングでは、モデルを複雑にするほど学習データへの適合度を高めることができます。

しかし、複雑化しすぎたモデルは、

- ノイズ

- 外れ値

- 偶然の偏り

まで学習してしまい、未知データに対する予測性能が低下することがあります。

この問題は「過学習(Overfitting)」と呼ばれ、AI開発における代表的な課題の一つです。

その過学習を防ぐために利用される技術が「正則化(Regularization)」です。

中でも、最も広く利用されている代表的な正則化手法が「L2正則化(L2 Regularization)」です。

L2正則化は、モデル全体を安定的かつ滑らかに学習させる特徴があり、深層学習でも非常に重要な役割を担っています。

本記事では、L2正則化の基本概念から、L1正則化との違い、リッジ回帰との関係、実際の活用例までをわかりやすく解説します。

L2正則化とは?

L2正則化とは、モデルのパラメータの「二乗和」にペナルティを与える正則化手法です。

簡単に言えば、「極端に大きな重みが発生するのを防ぐ」ための技術です。

なぜ正則化が必要なのか?

機械学習モデルは、複雑にするほど学習データへ強く適合できます。

しかし適合しすぎると、

- ノイズ

- 偶然のパターン

- 外れ値

まで学習してしまいます。

その結果、未知データへの性能が低下します。

これが「過学習」です。

過学習のイメージ

たとえば試験勉強で、

- 本質を理解している → 初見問題にも対応できる

- 過去問を丸暗記した → 少し変わると解けない

という違いがあります。

過学習したAIは、後者の状態に近い状態です。

L2正則化の仕組み

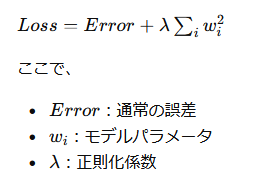

L2正則化では、通常の損失関数に「重みの二乗和」を追加します。

L2正則化の数式

基本形は以下の通りです。

を表します。

正則化係数 λ\lambda の役割

λ\lambda は、どれだけ強く正則化するかを決める重要なハイパーパラメータです。

λ\lambda が小さい場合

- モデルの自由度が高い

- 複雑なモデルになりやすい

λ\lambda が大きい場合

- 重みに強い制約を与える

- モデルがシンプルになる

- 過学習を抑えやすい

L2正則化の最大の特徴

すべての重みを均等に小さくする

L2正則化は、特定のパラメータだけを削除するのではなく、「全体の重みをバランスよく抑える」特徴があります。

なぜ重要なのか?

もし一部の重みだけ極端に大きくなると、特定特徴への過度な依存が起こります。

L2正則化は、その偏りを抑え、

- 安定性

- 汎化性能

を高めます。

L2正則化のイメージ

L2正則化は、「モデルに極端な判断をさせない」仕組みとも言えます。

その結果、

- なめらかな予測

- 安定した学習

につながります。

リッジ回帰(Ridge Regression)とは?

回帰分析にL2正則化を適用したものを、「リッジ回帰(Ridge Regression)」と呼びます。

リッジ回帰の特徴

リッジ回帰では、

- すべての特徴量を活かしつつ

- 重みの暴走を防ぐ

ことができます。

そのため、多数の特徴量が関係する問題に適しています。

L1正則化との違い

L2正則化は、L1正則化とよく比較されます。

L1正則化の数式

L1正則化では、重みの絶対値和を利用します。

![]()

L1とL2の違い

L1正則化

- 一部の重みを0にする

- 特徴量選択が可能

- スパースモデルを作る

L2正則化

- 全体を滑らかに小さくする

- 安定性が高い

- 多特徴量問題に強い

どちらを使うべき?

用途によって異なります。

L1正則化が向くケース

- 不要特徴を削除したい

- 解釈性重視

- 特徴量数が非常に多い

L2正則化が向くケース

- 安定性重視

- 多数の特徴量を活用したい

- 深層学習

実務では、両者を組み合わせた「Elastic Net」もよく利用されます。

深層学習でのL2正則化

L2正則化は、ニューラルネットワークで特に重要です。

Weight Decay(ウェイト減衰)

深層学習では、L2正則化は「Weight Decay(ウェイト減衰)」として実装されることも多くあります。

これは、学習中に重みを少しずつ減衰させる仕組みです。

なぜ深層学習で重要なのか?

現代AIは巨大化が進んでいます。

特に、

- 大規模言語モデル(LLM)

- 画像生成AI

- 音声認識AI

では、膨大なパラメータを扱います。

L2正則化は、

- 重みの暴走防止

- 学習安定化

- 汎化性能向上

に重要な役割を果たしています。

L2正則化のメリット

学習が安定しやすい

極端な重みを抑えられるため、学習が安定します。

多特徴量問題に強い

多くの特徴量が少しずつ重要な問題に向いています。

深層学習と相性が良い

勾配ベース最適化との相性が非常に良好です。

L2正則化の注意点

特徴量削除は苦手

L2正則化は、重みを小さくはしますが、完全に0にはしにくい特徴があります。

そのため、明確な特徴量選択には向きません。

正則化しすぎると性能低下

λ\lambda を大きくしすぎると、

- モデルが単純化しすぎる

- 学習不足(Underfitting)

になる場合があります。

まとめ

L2正則化(L2 Regularization)とは、パラメータの二乗和へペナルティを与える正則化手法です。

主な特徴は、

- 重み全体を滑らかに抑制

- 過学習防止

- 学習安定化

- 汎化性能向上

にあります。

また、回帰分析では「リッジ回帰」として知られ、深層学習では「Weight Decay」として広く活用されています。

現代AIではモデルの巨大化が進む中、L2正則化は高性能AIを安定的に学習させるための重要な基盤技術となっています。

こちらもご覧ください:L1正則化とは?特徴量選択を実現する機械学習の重要手法をわかりやすく解説