生成AIや深層学習の分野では、「VAE(変分オートエンコーダ)」が重要な生成モデルとして広く利用されています。

しかし、従来のVAEには「潜在変数が十分に情報を保持できない」という課題がありました。

その問題を改善するために提案されたのが、InfoVAE(Information Maximizing Variational Autoencoder) です。

InfoVAEは、「入力データと潜在変数の相互情報量」を重視することで、より豊かな潜在表現を学習できるよう設計されたVAE拡張モデルです。

この記事では、InfoVAEの仕組みやVAEとの違い、相互情報量の考え方、潜在空間崩壊問題との関係、活用例まで分かりやすく解説します。

InfoVAEとは

InfoVAE(Information Maximizing Variational Autoencoder)は、VAEを改良した生成モデルです。

通常のVAEでは、

- データを潜在空間へ圧縮

- 潜在変数からデータを生成

という流れで学習します。

しかしVAEでは、潜在変数が「事前分布」に強く引っ張られすぎることで、入力データの特徴が十分に保持されないケースがあります。

InfoVAEは、この問題を改善するために、

- 入力データ

- 潜在変数

の間の「相互情報量(Mutual Information)」を最大化する仕組みを導入しています。

まずはVAEを簡単に理解しよう

InfoVAEはVAEを発展させたモデルです。

まずVAEの基本を整理しておきましょう。

VAE(変分オートエンコーダ)とは

VAEは、データを確率分布として学習する生成モデルです。

通常のオートエンコーダでは、

入力 → 圧縮 → 復元という処理を行います。

一方VAEでは、

入力 → 分布 → サンプリング → 復元という流れになります。

潜在空間を確率分布として扱うことで、新しいデータ生成が可能になります。

VAEの問題点

VAEは非常に重要なモデルですが、代表的な課題があります。

それが「潜在空間崩壊(Posterior Collapse)」です。

潜在変数が情報を持たなくなる

VAEでは、潜在変数を事前分布へ近づける制約があります。

代表的には以下のKLダイバージェンス項です。

つまり、

どんな入力でも似た潜在表現になるという状態が発生します。

これが潜在空間崩壊です。

InfoVAEの核心:「相互情報量」

InfoVAEでは、この問題を解決するために「相互情報量」を学習目標へ導入します。

相互情報量とは

相互情報量(Mutual Information)とは、「2つの変数がどれだけ情報を共有しているか」を表す指標です。

簡単に言えば、

- 入力データ

- 潜在変数

の関連性の強さを意味します。

InfoVAEの考え方

InfoVAEでは、

潜在変数は入力情報をしっかり保持すべきという考え方を重視します。

つまり、

- 入力画像の特徴

- データの多様性

- 構造的情報

を潜在空間へ十分に反映させようとします。

InfoVAEの学習目標

InfoVAEでは、通常の再構成誤差に加え、複数の目的関数を同時に最適化します。

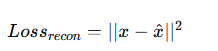

再構成誤差

まず、入力データを正しく復元する必要があります。

代表的な式は次の通りです。

潜在分布制約

潜在変数が極端な分布にならないよう制御します。

相互情報量の最大化

さらに、

入力と潜在変数の関係を強く保つための項を追加します。

これによって、

- 表現力

- 多様性

- 情報保持能力

が向上します。

InfoVAEのメリット

潜在空間崩壊を抑制できる

最大の利点は、潜在変数が意味を持ちやすくなることです。

入力情報が潜在空間へ適切に保存されます。

多様なデータ生成が可能

VAEでは似た画像ばかり生成される場合があります。

InfoVAEでは、より多様性の高いサンプル生成が期待できます。

表現学習性能が向上

潜在表現がデータ構造をより豊かに反映します。

そのため、

- 特徴抽出

- クラスタリング

- 異常検知

などでも有効です。

InfoVAEと通常VAEの違い

通常VAE

通常VAEでは、

事前分布への一致が強く重視されます。

その結果、潜在空間が単純化されすぎる場合があります。

InfoVAE

InfoVAEでは、

入力情報をしっかり保持することを優先します。

つまり、

- 再構成性能

- 潜在空間の表現力

- 生成品質

のバランスを改善しています。

InfoVAEの活用分野

画像生成

画像生成AIでは、より多様な画像生成に利用されます。

表現学習

潜在空間を利用した特徴抽出に向いています。

異常検知

正常データ分布をより正確に学習できます。

医療AI

医療画像の特徴抽出や解析にも応用されています。

InfoVAEと生成AIの関係

現在の生成AIでは、

- Diffusion Model

- GAN

- Transformer

などさまざまな技術があります。

その中でもInfoVAEは、

- 潜在空間学習

- 表現学習

- 情報保持

という観点で重要な研究テーマになっています。

特に「潜在空間がどれだけ意味を持つか」は、生成AIの品質に直結する重要要素です。

関連するVAE派生モデル

InfoVAE以外にも、多くのVAE派生モデルがあります。

β-VAE

潜在特徴の分離性を高めるモデルです。

VQ-VAE

潜在空間を離散化したモデルで、音声生成などに利用されます。

Conditional VAE(CVAE)

条件付き生成を行うモデルです。

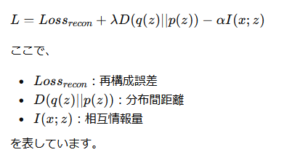

InfoVAEの数式イメージ

InfoVAEでは、VAEの損失関数へ情報量制約を追加します。

概念的には次のようになります。

を表しています。

InfoVAEでは、このバランス調整が非常に重要になります。

まとめ

InfoVAE(Information Maximizing Variational Autoencoder)は、VAEの情報保持問題を改善するために提案された生成モデルです。

入力データと潜在変数の相互情報量を最大化することで、より豊かな潜在表現を学習できます。

ポイントを整理すると、以下の通りです。

- VAEを改良した生成モデル

- 相互情報量を重視する

- 潜在空間崩壊を抑制できる

- 多様なデータ生成が可能

- 表現学習性能が高い

InfoVAEは、生成AIや表現学習の発展を理解するうえで、非常に重要な発展型VAEモデルの一つです。