生成AIや深層学習の分野では、「潜在空間をどれだけ分かりやすく整理できるか」が重要な研究テーマになっています。

その中で注目されているのが、**β-VAE(Beta Variational Autoencoder)**です。

β-VAEは、通常のVAE(変分オートエンコーダ)を改良し、「データの特徴を分離して学習しやすくしたモデル」です。

例えば画像生成では、

- 回転

- 色

- サイズ

- 形状

といった特徴を、潜在空間の異なる次元へ分けて表現できる可能性があります。

これによって、

- 解釈しやすいAI

- 制御可能な生成AI

- 要因分析

などが実現しやすくなります。

この記事では、β-VAEの仕組みや通常VAEとの違い、「もつれ問題(entanglement)」、特徴分離、メリット・デメリットまで分かりやすく解説します。

β-VAEとは

β-VAE(Beta Variational Autoencoder)は、VAEを拡張した生成モデルです。

通常のVAEでは、

- データを潜在空間へ圧縮

- 潜在変数からデータを復元

という流れで学習します。

しかし通常VAEでは、潜在空間に複数の特徴が混ざり合ってしまう問題がありました。

β-VAEでは、この問題を改善するために、

潜在変数をより独立的に整理することを目指します。

まずはVAEを簡単に整理

β-VAEを理解するために、まずVAEを簡単に振り返ります。

VAE(変分オートエンコーダ)とは

VAEは、データを確率分布として学習する生成モデルです。

通常のオートエンコーダが「固定ベクトル」へ圧縮するのに対し、VAEでは「確率分布」として表現します。

例えば、

画像 → 潜在分布 → サンプリング → 復元という流れになります。

これにより、新しいデータ生成が可能になります。

VAEの課題:「もつれ問題」とは

通常VAEでは、潜在空間の各次元へ複数の特徴が混在することがあります。

これを「もつれ(Entanglement)」と呼びます。

特徴が混ざるとは?

例えば顔画像を学習した場合、

- 表情

- 髪型

- 顔の向き

- 明るさ

などの情報が、同じ潜在次元へ混ざって保存される場合があります。

すると、

笑顔だけ変えたいといった制御が難しくなります。

β-VAEの核心:「特徴分離」

β-VAEでは、潜在空間をより整理された状態にすることを重視します。

潜在変数を独立化する

β-VAEでは、

- 回転

- サイズ

- 色

- 位置

などの特徴を、それぞれ別の潜在次元へ分離しやすくします。

例えば、

z1 = 回転

z2 = 大きさ

z3 = 色のような状態を目指します。

解釈しやすいAIになる

この性質により、

- 「どの次元が何を表しているか」

- 「どの特徴が変化したか」

を理解しやすくなります。

これはExplainable AI(説明可能AI)の観点でも重要です。

β-VAEの仕組み

β-VAEは、通常VAEの損失関数を調整したモデルです。

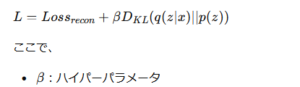

通常VAEの損失関数

通常VAEでは、

- 再構成誤差

- KLダイバージェンス

を同時に最適化します。

代表的な式は次の通りです。

![]()

β-VAEで追加される「β」

β-VAEでは、KLダイバージェンス項へ係数βを追加します。

です。

βを大きくすると何が起きるのか

βを1より大きくすると、潜在変数への制約が強くなります。

すると、

- 情報が圧縮される

- 潜在空間が整理される

- 特徴分離が進みやすくなる

という効果が得られます。

β-VAEの具体例

例えば物体画像を学習した場合、

通常VAE

1つの次元に複数特徴が混在β-VAE

ある次元 → 回転

別の次元 → 大きさ

別の次元 → 色のように、特徴が整理されやすくなります。

β-VAEのメリット

解釈可能性が高い

潜在変数の意味を理解しやすくなります。

制御しやすい生成AI

特定の特徴だけ変更できます。

例えば、

- 顔の向きだけ変更

- 明るさだけ変更

などが可能になります。

教師なし学習で特徴分離可能

ラベルなしデータでも特徴要因を抽出できます。

ロボット制御にも有効

環境変化要因を整理しやすくなるため、制御系AIでも研究されています。

β-VAEのデメリット

再構成精度が低下する場合がある

βを大きくしすぎると、情報圧縮が強すぎて細部が失われます。

生成品質とのトレードオフ

特徴分離を重視すると、画像品質が低下するケースがあります。

つまり、

解釈性 vs 再現性のバランス調整が重要です。

β-VAEと通常VAEの違い

| 項目 | VAE | β-VAE |

|---|---|---|

| 主目的 | 生成性能 | 特徴分離 |

| 潜在空間 | 混在しやすい | 整理されやすい |

| 解釈性 | 低め | 高い |

| 制御性 | 限定的 | 高い |

| 再構成精度 | 高め | β次第で低下 |

β-VAEの活用分野

画像生成AI

顔画像やキャラクター生成などで利用されます。

異常検知

特徴要因を分離しながら異常解析できます。

医療AI

病変特徴の解釈性向上に活用されています。

ロボティクス

環境要因を整理しながら学習できます。

現代AIにおけるβ-VAEの重要性

近年のAIでは、

- 「高性能」

だけでなく、 - 「なぜそう判断したか」

も重要視されています。

β-VAEは、

- 解釈可能AI

- 表現学習

- 因子分解

- 制御可能生成

といった分野で重要な役割を持っています。

特に生成AIの「潜在空間を理解する研究」において、β-VAEは代表的な手法の一つです。

関連モデル

InfoVAE

情報保持能力を強化したVAEです。

VQ-VAE

潜在空間を離散化したモデルです。

Conditional VAE(CVAE)

条件付き生成を行います。

まとめ

β-VAE(Beta Variational Autoencoder)は、VAEの潜在空間をより整理し、特徴分離を実現する生成モデルです。

KLダイバージェンスへβ係数を導入することで、解釈可能性の高い潜在表現を学習できます。

ポイントを整理すると、以下の通りです。

- VAEを拡張した生成モデル

- 特徴分離(Disentanglement)を重視

- 潜在空間の解釈性が高い

- 特定特徴を制御しやすい

- 解釈性と再構成精度にトレードオフがある

β-VAEは、生成AI・説明可能AI・表現学習を理解するうえで非常に重要な技術の一つです。

こちらもご覧ください:InfoVAEとは?VAEとの違い・相互情報量・潜在空間崩壊をわかりやすく解説

towa-735x400.png)