ディープラーニングは、高い表現力を持つ一方で、「過学習(Overfitting)」という問題が発生しやすい特徴があります。

特にニューラルネットワークでは、膨大なパラメータを持つため、学習データに含まれるノイズや偶然の特徴まで覚え込んでしまうことがあります。

その結果、

- 学習データでは高精度

- 未知データでは低精度

という状態になる場合があります。

この過学習を防ぐための代表的な技術が「ドロップアウト(Dropout)」です。

ドロップアウトは、学習中に一部のノードをランダムに無効化することで、モデルの汎化性能を高める正則化手法として広く利用されています。

本記事では、ドロップアウトの仕組みや効果、共適応との関係、推論時の動作、アンサンブル学習との関連までをわかりやすく解説します。

ドロップアウトとは?

ドロップアウト(Dropout)とは、ニューラルネットワークの学習時に、一部のノードをランダムに無効化する正則化手法です。

簡単に言えば、「毎回少し違うネットワーク構造で学習する」ような仕組みです。

なぜドロップアウトが必要なのか?

ニューラルネットワークは、多数のパラメータを持つことで高い表現力を実現しています。

しかしその反面、

- 外れ値

- ノイズ

- 偶然のパターン

まで学習してしまう場合があります。

これが「過学習」です。

過学習とは?

過学習とは、モデルが学習データへ過剰に適応してしまう状態です。

過学習のイメージ

たとえば試験勉強で、

- 理解している → 初見問題にも対応可能

- 丸暗記している → 問題が少し変わると解けない

という違いがあります。

過学習したAIは、後者の状態に近くなります。

ドロップアウトの仕組み

ドロップアウトでは、学習中に一部のノードをランダムに停止します。

具体的には何をする?

たとえば、100個のノードがある場合、そのうち一部をランダムに無効化します。

無効化されたノードは、

- 出力しない

- 誤差逆伝播にも参加しない

状態になります。

イテレーションごとに変化する

ドロップアウトの特徴は、「毎回違うノードが停止される」点にあります。

つまり、

- 1回目 → Aノード停止

- 2回目 → Bノード停止

- 3回目 → Cノード停止

のように、毎回異なるネットワークで学習が行われます。

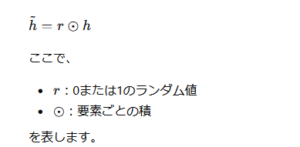

ドロップアウトの数式イメージ

ノード出力 hh に対して、ランダムマスク rr を適用します。

を表します。

0になったノードは、その回の学習では無効化されます。

ドロップアウトの最大の効果

特定ノードへの依存を防ぐ

ドロップアウトがない場合、ニューラルネットワークは、「特定の強力なノード」へ依存しやすくなります。

共適応(Co-adaptation)とは?

これは「共適応(Co-adaptation)」と呼ばれる現象です。

特定ノード同士が強く依存し合うことで、

- 他ノードが十分学習しない

- 柔軟性が低下する

問題が発生します。

ドロップアウトは共適応を防ぐ

ノードがランダムに停止するため、「特定ノードだけに頼れない」状態になります。

その結果、

- 多様な特徴抽出

- 複数経路での学習

が促進されます。

アンサンブル学習との関係

ドロップアウトは、「多数の異なるモデルを内部的に学習している」とも考えられます。

アンサンブル学習とは?

アンサンブル学習とは、複数モデルの予測を組み合わせて精度向上する手法です。

代表例には、

- ランダムフォレスト

- Boosting

などがあります。

ドロップアウトは“疑似アンサンブル”

ドロップアウトでは、毎回異なるネットワーク構造で学習するため、多数の小さなモデルを同時に学習しているような効果があります。

そのため、「軽量なアンサンブル学習」とも言われます。

推論時はどうなる?

重要なのは、「ドロップアウトは学習時のみ使う」点です。

推論時は全ノードを有効化

実際の推論では、すべてのノードを有効化します。

なぜ問題ないのか?

学習時にノードを減らしていたため、そのままだと出力スケールが変化します。

そこで一般的には、

- 重み

- 出力値

をスケーリングして補正します。

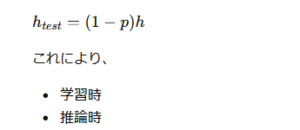

スケーリングのイメージ

ドロップ率を pp とすると、推論時に以下のような補正を行います。

の出力分布を整合させます。

ドロップアウトのメリット

過学習防止

最も大きな効果です。

特に深層ネットワークで有効です。

汎化性能向上

未知データへの対応力が向上します。

モデル依存性低減

特定ノードへの過度な依存を防げます。

実装が簡単

深層学習フレームワークでは簡単に利用できます。

ドロップアウトの注意点

学習速度が低下する場合がある

毎回ノードが変化するため、収束が遅くなるケースがあります。

ドロップ率調整が重要

ドロップ率が高すぎると、学習不足(Underfitting)になる可能性があります。

一般的には、0.2〜0.5程度がよく使われます。

現代AIとドロップアウト

現在でもドロップアウトは重要ですが、近年は、

- Batch Normalization

- Data Augmentation

- Weight Decay

- Layer Normalization

など他の正則化技術と組み合わせて利用されることが増えています。

Transformerではどう使われる?

Transformer系モデルでもドロップアウトは利用されています。

特に、

- Attention層

- Feed Forward層

などで過学習防止に使われます。

大規模言語モデル(LLM)でも重要な技術です。

まとめ

ドロップアウト(Dropout)とは、学習時に一部ノードをランダムに無効化する正則化手法です。

主な特徴として、

- 過学習防止

- 共適応抑制

- 汎化性能向上

- 疑似アンサンブル効果

などがあります。

また、

- 学習時のみノード停止

- 推論時は全ノード利用

- スケーリング補正が必要

という点も重要です。

ドロップアウトは、現代ディープラーニングにおける代表的な正則化技術の一つであり、多くのAIシステムで活用されています。

こちらもご覧ください:L2正則化とは?過学習を防ぐ機械学習の代表的手法をわかりやすく解説