現在のAIやディープラーニングの基礎には、「ニューラルネットワーク」という考え方があります。

その原型となったのが、**単純パーセプトロン(Single-layer Perceptron)**です。

単純パーセプトロンは、人間の脳の神経細胞(ニューロン)の働きを参考に設計された、最も基本的な機械学習モデルの一つです。

現代の高度な生成AIや画像認識AIと比べると非常にシンプルですが、

- AIがどのように学習するのか

- ニューラルネットワークがどのように判断するのか

を理解するうえで欠かせない存在です。

この記事では、単純パーセプトロンの仕組みや学習方法、限界、多層パーセプトロンとの違いまで、初心者にも分かりやすく解説します。

単純パーセプトロンとは

単純パーセプトロンとは、入力データをもとに分類や判定を行う最も基本的なニューラルネットワークです。

簡単に言えば、

複数の情報を組み合わせて「YES / NO」を判断する仕組みです。

例えば、

- メールが迷惑メールか

- 画像が猫か犬か

- 商品レビューがポジティブかネガティブか

といった単純な分類問題へ利用できます。

パーセプトロンの発想は「脳」から生まれた

単純パーセプトロンは、人間の脳の神経細胞を参考にしています。

ニューロンとは

脳には「ニューロン(神経細胞)」が存在します。

ニューロン同士はネットワーク状につながっており、電気信号をやり取りしています。

これによって、

- 学習

- 記憶

- 認識

- 判断

などが実現されています。

脳をコンピュータで再現する

研究者たちは、

脳の仕組みを機械で再現できないかと考えました。

その結果生まれたのが「パーセプトロン」です。

単純パーセプトロンの歴史

単純パーセプトロンは1957年に、アメリカの情報科学者である Frank Rosenblatt によって提案されました。

当時は「機械が学習する」という概念自体が非常に革新的でした。

Mark I Perceptron

1958年には「Mark I Perceptron」という専用コンピュータも試作されています。

これはAI専用ハードウェアの先駆けともいえる存在でした。

単純パーセプトロンの構造

単純パーセプトロンは、非常にシンプルな構造を持っています。

主に以下の2層で構成されます。

- 入力層

- 出力層

入力層とは

入力層は、外部からデータを受け取る部分です。

例えば画像認識なら、

- 色

- 明るさ

- 形状

などの特徴量が入力されます。

出力層とは

出力層は、最終的な判断結果を出力します。

例えば、

0 = 犬

1 = 猫のような分類結果を返します。

重み(Weight)の役割

単純パーセプトロンで重要なのが「重み(Weight)」です。

重みとは何か

重みとは、

どの情報をどれだけ重要視するかを表す値です。

例えば猫判定AIなら、

- 耳の形 → 重要

- 背景 → あまり重要ではない

といった重要度を学習します。

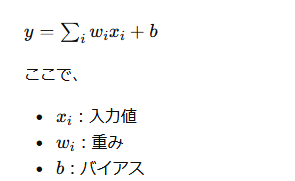

重み付き和の計算

入力値には重みが掛け合わされ、合計値が計算されます。

基本式は次の通りです。

を表します。

バイアスとは

バイアスは、判断基準を調整するための値です。

例えば、

どのくらいの条件で「猫」と判定するかを調整する役割があります。

単純パーセプトロンの学習方法

単純パーセプトロンは、正解データを使って学習します。

学習の流れ

基本的な流れは次の通りです。

- 入力データを与える

- 出力結果を計算する

- 正解と比較する

- 間違いに応じて重みを修正する

この繰り返しによって、徐々に精度が向上します。

学習後に何が起きるのか

学習後は、似た特徴を持つデータに対して正しい判断ができるようになります。

つまり、

重みそのものが「記憶」の役割を果たすとも考えられます。

単純パーセプトロンの限界

単純パーセプトロンには大きな弱点があります。

それが、

線形分離可能な問題しか解けないという点です。

線形分離とは

線形分離とは、

1本の直線で分類できることを意味します。

例えば、単純なYES/NO分類は可能です。

しかし、

- 複雑な画像認識

- 高度なパターン分析

には対応できません。

XOR問題とは

単純パーセプトロンの限界を示す有名な例が「XOR問題」です。

XORでは、

入力が異なるときだけ1を出力します。

この問題は直線では分類できないため、単純パーセプトロンでは解決不可能でした。

多層パーセプトロンへの発展

この問題を克服するために登場したのが、「多層パーセプトロン(MLP)」です。

隠れ層の追加

多層パーセプトロンでは、

- 入力層

- 隠れ層

- 出力層

を持ちます。

なぜ隠れ層が重要なのか

隠れ層を追加することで、

- 非線形問題

- 複雑な特徴抽出

- 高度なパターン認識

が可能になります。

ディープラーニングとの関係

隠れ層をさらに増やしたものが、

- DNN(ディープニューラルネットワーク)

- CNN

- Transformer

など、現代AIの基盤になっています。

つまり、単純パーセプトロンは現在のAI技術の出発点ともいえる存在です。

単純パーセプトロンのメリット

構造がシンプル

AI初心者でも理解しやすいモデルです。

学習原理を理解しやすい

ニューラルネットワークの基礎概念を学べます。

計算コストが低い

小規模問題では高速に動作します。

単純パーセプトロンのデメリット

表現力が低い

複雑問題には対応できません。

線形分離しかできない

高度な認識タスクには不向きです。

現代AIにおける意義

現在では単純パーセプトロン単体が実用される場面は少なくなっています。

しかし、

ニューラルネットワークの原点として極めて重要です。

現在の生成AIや深層学習も、

- 重み

- ニューロン

- 学習

という基本概念を受け継いでいます。

まとめ

単純パーセプトロン(Single-layer Perceptron)は、人間の脳のニューロン構造を参考に作られた最も基本的なニューラルネットワークです。

現代AIの基礎となる重要技術であり、多層ニューラルネットワークやディープラーニングへ発展する出発点となりました。

ポイントを整理すると、以下の通りです。

- 入力層と出力層のみのシンプル構造

- 重み付き和によって判断する

- 学習によって重みを更新する

- 線形分離問題のみ対応可能

- 現代AIの原型となった技術

単純パーセプトロンを理解することは、ニューラルネットワークや深層学習を学ぶ第一歩になります。