近年の生成AIブームによって、「画像生成AI」や「データ生成モデル」への注目が急速に高まっています。

その中で重要な基礎技術として知られているのが、**変分オートエンコーダ(Variational Autoencoder:VAE)**です。

VAEは、通常のオートエンコーダを発展させた深層学習モデルであり、「データを生成できる」という点が大きな特徴です。

現在では、

- 画像生成AI

- 音声生成

- 異常検知

- 創薬AI

- 潜在空間学習

など、幅広い分野で活用されています。

この記事では、VAEの基本概念から仕組み、通常のオートエンコーダとの違い、再パラメータ化トリック、生成AIとの関係まで、初心者にも分かりやすく解説します。

変分オートエンコーダ(VAE)とは

変分オートエンコーダ(VAE)は、データの特徴を「確率分布」として学習する生成モデルです。

通常のオートエンコーダでは、入力データを固定的な潜在表現へ圧縮します。

一方VAEでは、潜在表現を「単一の点」ではなく、「分布」として扱います。

これにより、

- 新しいデータを生成できる

- 潜在空間が滑らかになる

- 類似データを自然につなげられる

という特徴を持ちます。

そもそもオートエンコーダとは

VAEを理解する前に、通常のオートエンコーダを簡単に整理しておきましょう。

オートエンコーダは、

- 入力データを圧縮する「エンコーダ」

- 元データを復元する「デコーダ」

から構成されるニューラルネットワークです。

例えば画像の場合、

画像 → 圧縮 → 復元画像という流れで学習します。

目的は、「データの本質的特徴」を抽出することです。

VAEと通常オートエンコーダの違い

通常のオートエンコーダ

通常のオートエンコーダでは、入力データは1つの潜在ベクトルへ圧縮されます。

つまり、

入力画像 → 固定ベクトルという形です。

しかし、この方法では潜在空間が不規則になりやすく、新しいデータ生成には向いていません。

VAEの特徴

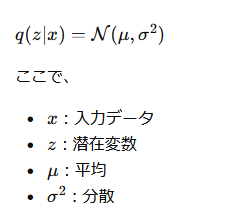

VAEでは、潜在表現を「確率分布」として扱います。

エンコーダは、

- 平均(Mean)

- 分散(Variance)

を出力します。

つまり、

入力画像 → 分布として表現されます。

この分布からランダムサンプリングを行い、デコーダへ入力します。

VAEの潜在空間とは

VAEの最大の特徴は、「滑らかな潜在空間」を学習することです。

潜在空間とは

潜在空間(Latent Space)とは、データの特徴を圧縮した内部空間のことです。

例えば顔画像を学習した場合、

- 髪型

- 顔の向き

- 表情

などの特徴が潜在空間に整理されます。

VAEでは連続的な空間になる

通常のオートエンコーダでは、潜在空間に空白や不連続が発生することがあります。

しかしVAEでは、確率分布を利用することで、滑らかで連続的な潜在空間を形成します。

これによって、

- 少しずつ表情を変える

- 顔の向きを変える

- 新しい画像を自然生成する

といったことが可能になります。

VAEの基本構造

VAEは主に以下で構成されます。

- エンコーダ

- 潜在変数

- デコーダ

エンコーダ

入力データから平均と分散を計算します。

例えば次のような形です。

を表します。

潜在変数のサンプリング

平均と分散からランダムサンプリングを行います。

これによって「生成能力」が生まれます。

デコーダ

サンプリングされた潜在変数からデータを復元します。

潜在変数 → 新しい画像生成という流れです。

VAEの学習方法

VAEでは、次の2つを同時に最適化します。

再構成誤差

入力データを正しく復元できるかを評価します。

例えば、

![]()

です。

KLダイバージェンス

潜在分布が理想的な分布に近づくよう制約をかけます。

代表的な式は次の通りです。

![]()

これにより、潜在空間が整理され、滑らかな生成が可能になります。

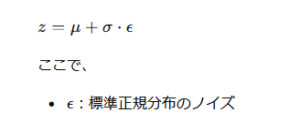

再パラメータ化トリックとは

VAEではランダムサンプリングが必要ですが、そのままでは誤差逆伝播ができません。

そこで利用されるのが「再パラメータ化トリック」です。

なぜ必要なのか

ニューラルネットワークは微分可能である必要があります。

しかしランダムサンプリングは微分できません。

解決方法

VAEでは、次のように変形します。

を表します。

この変換によって、勾配計算が可能になります。

VAEの主な用途

画像生成AI

VAEは画像生成モデルの基礎技術として有名です。

例えば、

- 顔画像生成

- アニメ画像生成

- 医療画像生成

などで利用されています。

Stable Diffusionとの関係

近年話題の画像生成AI「Stable Diffusion」でも、VAEの考え方が利用されています。

特に画像を潜在空間へ圧縮する部分で重要な役割を持っています。

異常検知

正常データ分布を学習し、異常データを検出できます。

創薬AI

VAEは新しい分子構造生成にも利用されています。

既存化合物の特徴を学習し、新しい候補分子を生成可能です。

VAEの代表的な派生モデル

VAEにはさまざまな拡張版があります。

β-VAE

特徴分離性能を強化したモデルです。

解釈性向上に利用されます。

VQ-VAE

潜在空間を離散化したモデルです。

音声生成や画像生成で利用されています。

InfoVAE

情報保持性能を改善したモデルです。

VAEのメリット

新しいデータを生成できる

単なる圧縮ではなく「生成」が可能です。

潜在空間が滑らか

類似データ間を自然につなげられます。

教師なし学習が可能

ラベルなしデータでも学習できます。

VAEのデメリット

画像がぼやけやすい

GANと比較すると、生成画像が滑らかすぎる場合があります。

学習設計が難しい

潜在次元や損失バランス調整が重要です。

現在の生成AIにおけるVAEの重要性

現在の生成AIでは、

- GAN

- Diffusion Model

- Transformer

などさまざまな技術があります。

その中でもVAEは、

- 潜在空間学習

- 確率生成

- 表現学習

の基礎として極めて重要です。

特に「潜在表現から新しいデータを作る」という考え方は、現代生成AIの中心的概念になっています。

まとめ

変分オートエンコーダ(VAE)は、潜在表現を確率分布として学習する生成モデルです。

通常のオートエンコーダを発展させることで、滑らかな潜在空間を形成し、新しいデータ生成を可能にしました。

ポイントを整理すると、以下の通りです。

- 潜在表現を確率分布として扱う

- 平均と分散を学習する

- 再構成誤差とKLダイバージェンスを最適化する

- 再パラメータ化トリックで学習可能になる

- 画像生成AIや創薬AIに活用されている

VAEは、生成AI時代を理解するうえで欠かせない重要技術の一つです。

こちらもご覧ください:積層オートエンコーダ(Stacked Autoencoder)とは?深層学習の歴史を支えた重要技術をわかりやすく解説