現在のAI・深層学習では、多層ニューラルネットワークによって高度な画像認識や自然言語処理が実現されています。

しかし、深いニューラルネットワークを安定して学習させることは、かつて非常に困難でした。

その課題を解決する重要な手法として登場したのが、**積層オートエンコーダ(Stacked Autoencoder)**です。

積層オートエンコーダは、複数のオートエンコーダを階層的に組み合わせることで、データの特徴を段階的に学習する深層学習モデルです。

現在主流のTransformer時代以前、ディープラーニング発展の基盤技術として大きな役割を果たしました。

この記事では、積層オートエンコーダの仕組みや特徴、事前学習との関係、歴史的意義まで、初心者にも分かりやすく解説します。

積層オートエンコーダ(Stacked Autoencoder)とは

積層オートエンコーダとは、複数のオートエンコーダを縦方向に積み重ねたニューラルネットワークです。

通常のオートエンコーダでは、

- 入力データを圧縮する「エンコーダ」

- 元データを復元する「デコーダ」

を使い、データの特徴を学習します。

積層オートエンコーダでは、この構造を何層にも重ねることで、より高度な特徴表現を獲得します。

通常のオートエンコーダとの違い

単層オートエンコーダ

通常のオートエンコーダは、1つの隠れ層で特徴を圧縮します。

イメージは次のようになります。

入力 → 圧縮 → 復元比較的シンプルな特徴を学習できます。

積層オートエンコーダ

積層オートエンコーダでは、圧縮された特徴をさらに次のオートエンコーダへ入力します。

入力

↓

第1エンコーダ

↓

第2エンコーダ

↓

第3エンコーダこのように多層化することで、より抽象的な特徴を学習できます。

なぜ「積層」するのか

深層学習では、層が深くなるほど高度な特徴を学習できると考えられています。

下位層では低レベル特徴を学習

最初の層では、

- エッジ

- 色

- 小さな形状

などの単純な特徴を学習します。

上位層では高レベル特徴を学習

深い層へ進むにつれて、

- 顔

- 物体

- 文脈

- 意味

など、より抽象的な概念を学習します。

これは人間の脳の情報処理にも似た考え方です。

積層オートエンコーダの仕組み

積層オートエンコーダでは、各層が段階的に特徴を抽出します。

例えば画像認識の場合、

画像

↓

線や輪郭

↓

パーツ

↓

顔や物体のように、徐々に抽象度が上がっていきます。

この階層的特徴学習が、深層学習の強みです。

事前学習(Pretraining)とは

積層オートエンコーダが特に重要視された理由が、「事前学習(Pretraining)」です。

昔の深層学習は学習が難しかった

現在ではGPUや学習技術の進歩によって深いネットワークを直接学習できます。

しかし以前は、

- 計算能力不足

- 勾配消失問題

- 最適化の難しさ

によって、多層ネットワークの学習が非常に困難でした。

一層ずつ順番に学習する

積層オートエンコーダでは、ネットワーク全体を一気に学習しません。

まず、

- 第1層を学習

- 第2層を学習

- 第3層を学習

というように、一層ずつ段階的に学習します。

これを「層ごとの事前学習」と呼びます。

事前学習のメリット

学習が安定する

初期状態から一気に深いネットワークを学習するよりも、安定して特徴を獲得できます。

計算負荷を軽減できる

一度に巨大なネットワークを学習する必要がありません。

ラベルなしデータを活用できる

オートエンコーダは教師なし学習のため、大量の未ラベルデータを利用できます。

ファインチューニングとは

全層の事前学習が終わった後、ネットワーク全体を微調整します。

これが「ファインチューニング(Fine-tuning)」です。

デコーダを取り除く

分類タスクでは、復元用のデコーダ部分は不要になります。

そのため、

- エンコーダ部分だけを残す

- 最後に分類層を追加する

という構成に変更します。

全体を再調整する

最後に、全ネットワークをまとめて学習します。

これによって、最終タスク向けに性能を最適化します。

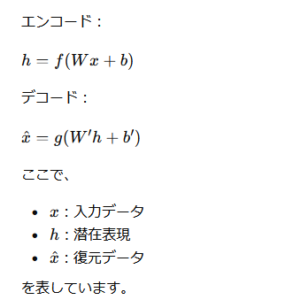

積層オートエンコーダの数式イメージ

オートエンコーダの基本構造は次のように表現できます。

積層オートエンコーダでは、この処理を多層にわたって繰り返します。

積層オートエンコーダの用途

特徴抽出

画像や音声などの高次元データから重要特徴を抽出できます。

次元削減

大量データを低次元へ圧縮し、解析しやすくします。

異常検知

正常データのみを学習させることで、異常データを検出できます。

深層学習の事前学習

かつてはディープニューラルネットワーク学習の主要手法でした。

現在の深層学習との違い

現在では、

- GPU性能向上

- Adamなど最適化手法の進化

- Batch Normalization

- Transformer

などの発展によって、事前学習なしでも深層ネットワークを直接学習できるようになりました。

そのため、積層オートエンコーダ単体が主役になる場面は以前より減っています。

それでも積層オートエンコーダが重要な理由

現在でも、積層オートエンコーダはAI史において非常に重要な存在です。

理由としては、

- 深層学習ブームの土台になった

- 事前学習の考え方を普及させた

- 表現学習の概念を発展させた

などがあります。

現在の自己教師あり学習や生成AIにも、その思想が引き継がれています。

まとめ

積層オートエンコーダ(Stacked Autoencoder)は、複数のオートエンコーダを階層的に組み合わせた深層学習モデルです。

特徴を段階的に抽出することで、より高度な表現学習を可能にしました。

ポイントを整理すると、以下の通りです。

- オートエンコーダを多層化したモデル

- 階層的な特徴学習が可能

- 事前学習によって深層学習を安定化

- ファインチューニングで性能を最適化

- 深層学習発展の歴史的重要技術

現在はTransformer時代となっていますが、積層オートエンコーダは「深層学習がどのように発展してきたか」を理解するうえで欠かせない重要技術です。

こちらもご覧ください:オートエンコーダ(Autoencoder)とは?仕組み・用途・VAEとの違いまでわかりやすく解説