高性能AIを軽量化する重要技術をわかりやすく解説

近年のAI技術、とくにディープラーニングの分野では、高精度なモデルほど巨大化する傾向があります。

例えば画像認識や自然言語処理では、大規模なニューラルネットワークによって驚異的な性能が実現されています。

しかしその一方で、モデルサイズの増大によって以下のような問題が発生します。

- 計算コストが高い

- メモリ消費量が大きい

- 推論速度が遅い

- スマートフォンやIoT機器で動かしにくい

こうした課題を解決する技術として注目されているのが「蒸留(Distillation)」です。

蒸留を利用すると、高性能な巨大モデルの知識を小型モデルへ効率よく継承できるため、軽量かつ高速なAIモデルを実現できます。

本記事では、蒸留の仕組み・メリット・具体例・活用シーンについて、初心者にも分かりやすく解説します。

蒸留(Distillation)とは?

蒸留(Knowledge Distillation)とは、

「大きく高性能なAIモデル(教師モデル)」の知識を

「小型で軽量なAIモデル(生徒モデル)」へ伝達する技術

のことです。

通常、精度の高いAIモデルはパラメータ数が非常に多く、計算負荷も大きくなります。

そこでまず、大規模で高精度な「教師モデル(Teacher Model)」を学習させ、その出力結果を利用して、小型の「生徒モデル(Student Model)」を学習させます。

これによって、生徒モデルは小型でありながら、高い性能を維持できるようになります。

蒸留の基本的な仕組み

蒸留では、単純な正解ラベルだけではなく、「教師モデルの出力確率」を利用して学習を行います。

通常の学習

一般的な分類問題では、正解ラベルのみを使います。

例:

| 入力画像 | 正解 |

|---|---|

| 猫の画像 | 猫 |

この場合、モデルは「猫かどうか」だけを学習します。

蒸留を使った学習

一方、教師モデルは次のような確率分布を出力します。

| クラス | 出力確率 |

|---|---|

| 猫 | 85% |

| トラ | 10% |

| 犬 | 5% |

この情報には、

- 猫とトラは似ている

- 犬とは少し異なる

といった「クラス間の関係性」が含まれています。

生徒モデルはこの“柔らかい情報(Soft Target)”を学習することで、単なる正解ラベル以上の知識を獲得できます。

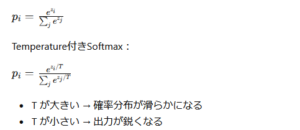

Softmax温度(Temperature)の役割

蒸留では「Temperature(温度)」というパラメータがよく利用されます。

Softmaxの出力を滑らかにすることで、クラス間の違いを学習しやすくします。

蒸留では通常、温度を高めに設定して、生徒モデルが教師モデルの知識構造を学習しやすくします。

蒸留のメリット

1. モデルを軽量化できる

最大の利点は、小型モデルでも高い精度を維持できる点です。

これにより、

- スマホ

- 組み込み機器

- IoTデバイス

- エッジAI

などでも実用化しやすくなります。

2. 推論速度が高速になる

モデルサイズが小さいため、推論処理が高速になります。

リアルタイム性が重要な、

- 音声認識

- 自動翻訳

- 自動運転

- 顔認識

などで大きな効果があります。

3. 消費電力を抑えられる

軽量モデルは計算量が少ないため、バッテリー消費も抑えられます。

モバイルAIでは非常に重要なポイントです。

4. 大規模モデルの知識を活用できる

巨大モデルを直接運用できない環境でも、その知識だけを転移できます。

これは「知識圧縮」とも呼ばれます。

蒸留の具体例

画像認識

高精度なCNNモデルを教師として、小型CNNへ知識を転移します。

例:

- ResNet → MobileNet

- EfficientNet → Tinyモデル

自然言語処理(NLP)

大規模言語モデルの軽量化にも蒸留は使われています。

代表例:

- BERT → DistilBERT

- GPT系モデルの軽量版

小型化しても実用レベルの性能を維持できるため、多くのサービスで活用されています。

音声認識

クラウド上の巨大モデルを教師として、スマホ内で動作する軽量モデルへ知識を転移します。

オフライン音声認識などで重要です。

蒸留と転移学習の違い

蒸留と混同されやすいのが「転移学習(Transfer Learning)」です。

転移学習

既存モデルの重みを流用して別タスクへ応用する技術。

例:

- 猫犬分類モデル

- ↓

- 医療画像分類へ応用

蒸留

教師モデルの「出力知識」を別モデルへ継承する技術。

つまり、

- 転移学習 → 重みを再利用

- 蒸留 → 知識を圧縮して継承

という違いがあります。

蒸留と破滅的忘却(Catastrophic Forgetting)の関係

蒸留は、「破滅的忘却(Catastrophic Forgetting)」の緩和にも利用されます。

破滅的忘却とは?

破滅的忘却とは、新しいタスクを学習した際に、以前学習した内容を急激に忘れてしまう現象です。

継続学習(Continual Learning)では特に大きな問題になります。

例えば:

- 猫と犬を識別するモデルを学習

- その後、車の識別を追加学習

- 猫・犬の性能が低下

このように、重み更新によって過去の知識が上書きされてしまいます。

なぜ深層学習で起きやすいのか

深層ニューラルネットワークでは、多数の入力で重みを共有しています。

そのため、新しいタスク用にパラメータを更新すると、既存タスクの内部表現まで変化しやすくなります。

特に以下で顕著です。

- 継続学習

- オンライン学習

- マルチタスク学習

破滅的忘却への対策

1. 正則化手法

重要なパラメータの更新を抑制します。

代表例:

- EWC(Elastic Weight Consolidation)

2. リプレイ(Rehearsal)手法

過去データを一部保存し、新しい学習時に混ぜて再学習します。

これにより、古い知識を維持しやすくなります。

3. アーキテクチャベース手法

タスクごとにネットワーク構造を分離します。

過去知識を物理的に保護できるのが特徴です。

4. 蒸留による知識保持

蒸留では、旧モデルの出力を保持しながら新モデルを学習できます。

つまり、

「以前のモデルの振る舞いを維持するように学習する」

ことで、古い知識を失いにくくできます。

継続学習では非常に重要な考え方です。

蒸留の課題

非常に有用な技術ですが、課題も存在します。

教師モデルの性能に依存する

教師モデルの質が悪いと、生徒モデルも十分な性能を得られません。

完全再現は難しい

極端に小さいモデルでは、教師モデルの性能を完全に再現できないことがあります。

学習コストが二重になる

まず教師モデルを学習し、その後に蒸留を行う必要があります。

そのため、開発時の計算コストは増加します。

まとめ

蒸留(Distillation)は、

「巨大で高性能なAIモデルの知識を、小型モデルへ効率よく継承する技術」

です。

特に近年では、

- モバイルAI

- エッジAI

- 大規模言語モデル(LLM)

- 継続学習

など、幅広い分野で重要性が高まっています。

また、破滅的忘却への対策としても応用されており、単なる軽量化技術に留まらず、AIの知識継承を支える重要技術として注目されています。

今後、AIモデルの巨大化がさらに進む中で、蒸留技術はますます不可欠な存在になっていくでしょう。