AIによる文章生成や音声認識、翻訳技術は、近年急速に進化しています。

こうした時系列データを扱うAI技術の基礎となったのが、「RNN(リカレントニューラルネットワーク)」です。

その中でも、「エルマンネットワーク(Elman Network)」は、文脈を保持しながら処理を行う仕組みを持つ初期のRNNモデルとして知られています。

現在のLSTMやTransformerのような高度なモデルにつながる重要な研究でもあり、自然言語処理の発展に大きな影響を与えました。

本記事では、エルマンネットワークの仕組みや特徴、ジョルダンネットワークとの違い、活用例、課題、現代AIとの関係までを初心者向けにわかりやすく解説します。

エルマンネットワークとは

エルマンネットワークとは、隠れ層(中間層)の出力を次回入力へフィードバックする構造を持つRNN(リカレントニューラルネットワーク)の一種です。

通常のニューラルネットワークでは、データは一方向に流れます。

入力 → 隠れ層 → 出力一方、エルマンネットワークでは、隠れ層の状態を「コンテキスト層」に保存し、次回の入力処理へ利用します。

入力 → 隠れ層 → 出力

↓

コンテキスト層

↑

└── 次回入力へこの仕組みにより、過去の文脈や内部状態を保持できるようになります。

なぜエルマンネットワークが重要なのか

「文脈」を扱えるようになったため

文章や音声では、単独の情報だけでは意味を理解できません。

例えば、

「私は昨日映画を見て、とても感動した」

という文章では、「感動した」が何に対する感情なのかを理解するには、前半部分の情報が必要です。

エルマンネットワークは、前回の内部状態を保持することで、こうした文脈情報を扱えるようにしました。

コンテキスト層の役割

エルマンネットワーク最大の特徴が「コンテキスト層」です。

コンテキスト層は、前回の隠れ層の状態を保存するメモリのような役割を持ちます。

処理の流れは以下のようになります。

- 現在入力を処理

- 隠れ層で特徴を抽出

- 隠れ層の状態を保存

- 次回入力時にその情報を利用

これによって、系列データの「流れ」を理解できるようになります。

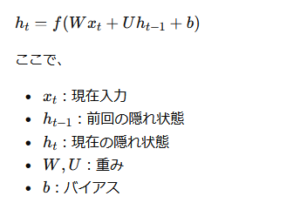

エルマンネットワークの基本構造

エルマンネットワークでは、

- 現在の入力

- 前回の隠れ状態

を組み合わせて現在状態を計算します。

概念的には以下のような式になります。

を表しています。

「現在入力」と「過去の内部状態」を組み合わせることが特徴です。

エルマンネットワークとジョルダンネットワークの違い

エルマンネットワークと比較される代表的なモデルが、「ジョルダンネットワーク(Jordan Network)」です。

エルマンネットワーク

- 隠れ層の状態を保存

- 中間状態を記憶

- 文脈保持に強い

ジョルダンネットワーク

- 最終出力を保存

- 結果ベースの記憶

- 制御処理向き

違いを比較すると

| 項目 | エルマンネットワーク | ジョルダンネットワーク |

|---|---|---|

| 保存対象 | 隠れ層 | 出力層 |

| 記憶内容 | 内部状態 | 最終結果 |

| 得意分野 | 自然言語処理 | 制御・予測 |

| 文脈保持 | 強い | 比較的弱い |

自然言語処理では、途中状態を保持できるエルマンネットワークの方が有利とされました。

エルマンネットワークの活用例

自然言語処理

文章の流れや文脈を考慮できます。

代表例:

- 機械翻訳

- 文章生成

- チャットボット

- 文法解析

音声認識

音の連続性を考慮できます。

前後の音情報を使うことで認識精度向上につながります。

時系列予測

過去状態を利用しながら未来予測が可能です。

例:

- 株価予測

- 気象予測

- センサーデータ分析

エルマンネットワークの課題

エルマンネットワークは革新的でしたが、問題もありました。

長期依存関係が苦手

系列が長くなると、古い情報を保持しにくくなります。

例えば長文では、文頭情報を後半で活用しづらくなります。

勾配消失問題

誤差逆伝播時に勾配が極端に小さくなる現象です。

現在 ← 過去 ← 過去 ← 過去

勾配 小 極小 ほぼ0これによって長期記憶の学習が困難になります。

LSTM・GRUへの発展

こうした課題を改善するために登場したのが、

- LSTM

- GRU

です。

これらは「ゲート機構」を導入することで、

- 必要情報の保持

- 不要情報の忘却

を制御できるようになりました。

現在のRNN系モデルでは、LSTMやGRUが広く利用されています。

Transformer時代との関係

現在の自然言語処理では、Transformer が主流です。

Transformerは、

- 並列計算可能

- 長距離依存に強い

- 学習速度が速い

という特徴を持っています。

現在の

- GPT

- BERT

などもTransformerベースです。

それでもエルマンネットワークを学ぶ価値

エルマンネットワークは、現代AIの基礎理解に非常に重要です。

特に、

- 文脈保持の考え方

- RNNの基本構造

- 時系列処理の原理

を理解するうえで役立ちます。

現在の高度なAIモデルも、こうした初期研究の積み重ねによって発展してきました。

まとめ

エルマンネットワーク(Elman Network)は、隠れ層の状態をコンテキスト層へ保存し、次回入力へ利用するRNNの一種です。

この仕組みにより、

- 文脈理解

- 時系列処理

- 過去情報の活用

が可能となりました。

特に自然言語処理分野に大きな影響を与え、後の

- LSTM

- GRU

- Transformer

などの発展につながっています。

現在ではより高性能なモデルが主流になっていますが、エルマンネットワークはRNN研究の基礎を築いた重要な技術として、今なお学ぶ価値の高い概念です。

こちらもご覧ください:ジョルダンネットワーク(Jordan Network)とは?RNNの初期モデルをわかりやすく解説