ディープラーニングでは、モデルを効率よく学習させるために「正規化層(Normalization Layer)」という重要な仕組みが使われています。

ニューラルネットワークは層を深く重ねることで高い表現力を実現できますが、その一方で、

- 学習が不安定になる

- 勾配消失が起こる

- 学習速度が遅くなる

といった問題も発生しやすくなります。

こうした課題を改善するために導入されるのが正規化層です。

本記事では、正規化層の基本的な仕組みから、代表的な手法、メリット・デメリット、実際の活用例までをわかりやすく解説します。

正規化層(Normalization Layer)とは

正規化層とは、ニューラルネットワーク内部で扱うデータの「スケール(値の大きさ)」を整えるための層です。

ディープラーニングでは、入力データが各層を通過するたびに値の分布が変化します。

もし層ごとに値の大きさが大きく異なると、

- 特定の特徴だけが強調される

- 学習が不安定になる

- 一部のパラメータ更新が遅くなる

などの問題が発生します。

正規化層は、こうした値のばらつきを調整し、学習を安定化する役割を担います。

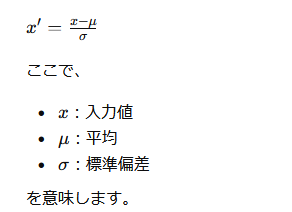

正規化とは何をしているのか

正規化では、データの平均と分散を調整します。

一般的には、

- 平均を0

- 分散を1

に近づけるよう変換します。

数式で表すと、正規化は次のような処理です。

を意味します。

この処理によって、データ分布を揃えやすくなります。

なぜ正規化が必要なのか

学習を安定化できる

ニューラルネットワークでは、層が深くなるほど値の分布が変化しやすくなります。

これを放置すると、

- 勾配爆発

- 勾配消失

などが発生し、学習が不安定になります。

正規化によって値の範囲を整えることで、安定した学習が可能になります。

学習速度を向上できる

値のスケールが揃うことで、最適化アルゴリズムが効率よく動作します。

その結果、

- 学習収束が速くなる

- エポック数を減らせる

場合があります。

特に大規模モデルでは重要な効果です。

過学習を抑制しやすい

正規化には、モデルの過度な適応を抑える効果もあります。

そのため、未知データへの対応力(汎化性能)が向上するケースがあります。

代表的な正規化手法

現在では、さまざまな正規化技術が利用されています。

バッチ正規化(Batch Normalization)

最も有名な手法が「バッチ正規化(Batch Normalization)」です。

仕組み

ミニバッチ単位で、

- 平均

- 分散

を計算し、特徴量ごとに正規化を行います。

バッチ正規化のメリット

- 学習高速化

- 深いネットワークの安定化

- 初期値依存の軽減

など、多くの利点があります。

現在のCNNではほぼ標準技術となっています。

バッチ正規化の注意点

バッチサイズが極端に小さい場合、統計量が不安定になることがあります。

そのため、小規模バッチ学習では別手法が選ばれる場合もあります。

レイヤー正規化(Layer Normalization)

レイヤー正規化は、1つのサンプル内部で正規化を行う方法です。

特徴

- バッチサイズに依存しない

- Transformer系モデルで多用される

という特徴があります。

特に自然言語処理(NLP)分野で重要です。

インスタンス正規化(Instance Normalization)

インスタンス正規化は、画像ごと・チャネルごとに正規化する方法です。

主な用途

- 画像生成AI

- スタイル変換

- GAN

などで利用されます。

画像の見た目調整に強みがあります。

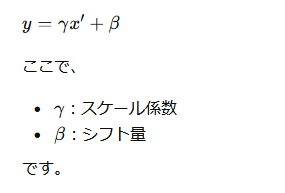

正規化後に行われる追加処理

実際の正規化層では、単純に平均0・分散1へ変換するだけではありません。

学習可能なパラメータを使い、

- スケール調整

- 平行移動

を行う場合があります。

数式では次のように表されます。

です。

これによって、必要な表現力を維持しながら正規化できます。

正規化層のメリット

深いネットワークを学習しやすい

深層CNNやTransformerなど、大規模モデルの安定学習に欠かせません。

高速学習が可能

学習収束が早まり、トレーニング時間短縮につながります。

ハイパーパラメータ調整が楽になる

学習率設定などに対する敏感さが減るため、モデル調整がしやすくなります。

正規化層のデメリット

計算コストが増える

平均・分散計算が必要になるため、若干の計算負荷が増加します。

バッチ依存の問題

バッチ正規化では、小バッチ時に性能低下するケースがあります。

タスクによって最適手法が異なる

画像認識・自然言語処理・生成AIなどで適した正規化方法が異なります。

そのため、用途に応じた選択が重要です。

正規化層が使われる代表的なAIモデル

正規化層は、現在のほぼすべての深層学習モデルで利用されています。

主な活用例

- ResNet

- Transformer

- BERT

- GPT

- StyleGAN

特に大規模AIモデルでは、正規化技術が性能を支える重要要素になっています。

まとめ

正規化層(Normalization Layer)は、ニューラルネットワーク内部の値のスケールを整え、学習を安定化するための重要な技術です。

代表的な手法には、

- バッチ正規化

- レイヤー正規化

- インスタンス正規化

などがあります。

正規化によって、

- 学習高速化

- 勾配問題の緩和

- 過学習抑制

- 深層モデルの安定化

といった効果が期待できます。

現在のディープラーニングでは欠かせない基盤技術であり、CNNやTransformerなどの高性能AIを支える重要な要素となっています。

こちらもご覧ください:グローバル平均プーリング(Global Average Pooling:GAP)とは?仕組みやメリットをわかりやすく解説