機械学習やディープラーニングでは、AIモデルの精度を高めるために「最適化」という重要な処理が行われます。

その最適化を高速かつ安定して進めるための代表的な技術が「モーメンタム(Momentum)」です。

モーメンタムは、現在の勾配だけでなく過去の更新情報も活用することで、学習をスムーズに進める手法として広く利用されています。

現在では、深層学習における基本技術の一つといえる存在です。

この記事では、モーメンタムの仕組みやメリット、通常の勾配降下法との違い、実際の活用例まで分かりやすく解説します。

モーメンタム(Momentum)とは

モーメンタム(Momentum)とは、機械学習における最適化アルゴリズムの一種です。

物理学の「運動量(Momentum)」の考え方を応用しており、過去の移動方向を保持しながらパラメータ更新を行う特徴があります。

通常の勾配降下法では、「現在の勾配」だけを見て更新方向を決定します。

しかしモーメンタムでは、過去の勾配情報も考慮することで、より効率的に最適解へ近づけます。

勾配降下法の基本

モーメンタムを理解する前に、まずは勾配降下法を簡単に確認しておきましょう。

勾配降下法(Gradient Descent)は、損失関数の値を小さくする方向へ少しずつ進みながら、最適なパラメータを探す手法です。

イメージとしては、「山の斜面を下って谷底を目指す」ようなものです。

更新の基本式は以下のようになります。

![]()

ここで使われる主な記号は次の通りです。

- θ(シータ):モデルのパラメータ

- η(イータ):学習率

- ∇J:損失関数の勾配

ただし、通常の勾配降下法には以下のような問題があります。

- 更新方向が左右に振動しやすい

- 平坦な場所で進みが遅くなる

- 局所最適解にハマる可能性がある

これらを改善するために登場したのがモーメンタムです。

モーメンタムの仕組み

モーメンタムでは、過去の勾配を蓄積しながら更新を行います。

簡単にいうと、「前回までの勢い」を利用して進むイメージです。

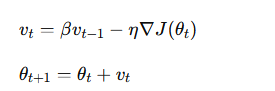

更新式は以下のようになります。

ここで重要なのが β(ベータ)です。

β は「減衰率」と呼ばれ、過去の勾配をどれくらい維持するかを決めます。

一般的には以下のような値が使われます。

- 0.9

- 0.95

- 0.99

値が大きいほど、過去の勢いを強く引き継ぎます。

モーメンタムが必要な理由

谷の中での振動を抑えられる

ニューラルネットワークの損失関数は、複雑な谷のような形状をしています。

通常の勾配降下法では、谷底付近で左右に細かく振動してしまい、なかなか前に進めないことがあります。

モーメンタムを使うと、一定方向への勢いが保たれるため、無駄な振動を減らしながら前進できます。

平坦な領域でも加速できる

勾配が小さい領域では、通常の勾配降下法は更新量が小さくなり、学習が非常に遅くなります。

モーメンタムでは過去の移動量が蓄積されるため、平坦な場所でも慣性によって進み続けられます。

その結果、学習速度が向上します。

局所最適解を抜け出しやすい

ニューラルネットワークでは、途中に小さな谷(局所最適解)が存在することがあります。

通常の勾配降下法では、その地点で止まってしまう場合があります。

しかしモーメンタムには「慣性」があるため、浅い谷を飛び越えて、より良い解を探索できる可能性があります。

モーメンタムのメリット

学習速度の向上

モーメンタム最大の利点は、最適化を高速化できる点です。

特に深層学習では、学習時間短縮に大きく貢献します。

安定した学習が可能

振動を抑えることで、学習が安定しやすくなります。

特に複雑なニューラルネットワークでは、収束性改善に効果があります。

計算資源を節約できる

学習回数を減らせるため、

- GPU使用時間削減

- 消費電力削減

- コスト削減

といった実務的メリットも期待できます。

モーメンタムのデメリットと注意点

ハイパーパラメータ調整が必要

減衰率 β の設定次第で性能が変わります。

大きすぎると勢いが強くなりすぎ、小さすぎると効果が弱くなります。

最適解を飛び越える可能性

勢いが強すぎると、最適な地点を通り過ぎてしまうことがあります。

そのため、学習率とのバランス調整が重要です。

AdamやRMSpropとの関係

現在の深層学習では、モーメンタムの考え方を発展させたアルゴリズムが広く使われています。

代表例は以下の通りです。

| 手法 | 特徴 |

|---|---|

| Momentum | 過去の勾配を利用 |

| RMSprop | 勾配の大きさを調整 |

| Adam | Momentum + RMSprop を組み合わせ |

特にAdamは現在最も利用される最適化手法の一つです。

実務でのモーメンタム活用例

モーメンタムは、以下のような分野で広く使われています。

- 画像認識

- 自然言語処理(NLP)

- 音声認識

- 生成AI

- 大規模言語モデル(LLM)

深層学習フレームワークである TensorFlow や PyTorch でも標準搭載されています。

まとめ

モーメンタム(Momentum)は、過去の勾配情報を活用して学習を効率化する最適化手法です。

通常の勾配降下法に比べて、

- 学習速度向上

- 振動抑制

- 局所最適解回避

といった多くのメリットがあります。

現在では、ディープラーニングの基本技術として幅広く活用されており、Adamなどの高度な最適化アルゴリズムにもその考え方が受け継がれています。

AI開発や機械学習を学ぶうえで、モーメンタムは理解しておきたい重要な概念の一つです。

こちらもご覧ください:Early Stopping(早期終了)とは?過学習を防ぐ重要なテクニックをわかりやすく解説