機械学習や深層学習を学んでいると、「局所最適解(Local Optimal Solution)」という言葉を目にすることがあります。

AIモデルの学習では、より良い答えを探すために「最適化」が行われます。

しかし、その過程で本当の最適解にたどり着けず、途中の“それらしく見える答え”で止まってしまうことがあります。

これが「局所最適解」の問題です。

特にニューラルネットワークのような複雑なモデルでは、局所最適解は学習結果に大きな影響を与える重要な概念です。

この記事では、局所最適解の意味や大域最適解との違い、AI学習で問題になる理由、そして代表的な対策方法まで、初心者にもわかりやすく解説します。

局所最適解とは?

局所最適解とは、

「周囲と比較すると最適に見えるが、全体で見ると最適とは限らない解」

のことです。

関数を山や谷の地形として考えると理解しやすくなります。

山登り・谷探しで考える局所最適解

例えば、山岳地帯で「最も低い谷底」を探しているとします。

しかし、探索している途中で小さな谷に到達すると、

- 周囲より十分低い

- これ以上下がる道が見つからない

という状態になります。

このとき探索アルゴリズムは、

「ここが最適解だ」

と判断して停止してしまう場合があります。

ですが、実際には別の場所にもっと深い谷が存在するかもしれません。

この“小さな谷”が局所最適解です。

大域最適解との違い

局所最適解と対になる概念が「大域最適解(Global Optimal Solution)」です。

大域最適解とは?

関数全体の中で、最も値が小さい(または大きい)解を指します。

つまり、本当の意味での「最適な答え」です。

局所最適解との比較

| 用語 | 意味 |

|---|---|

| 局所最適解 | 周囲では最適だが、全体では最適とは限らない |

| 大域最適解 | 関数全体で最も良い解 |

機械学習では、できるだけ大域最適解に近づけることが理想とされています。

なぜ機械学習で局所最適解が問題になるのか?

AIや機械学習では、モデルの誤差を最小化するために最適化処理を行います。

その際によく使われるのが「勾配降下法(Gradient Descent)」です。

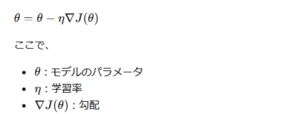

勾配降下法とは?

勾配降下法は、関数の傾きを利用して少しずつ最小値を探していくアルゴリズムです。

イメージとしては、

山の斜面を下りながら一番低い場所を探す

ような方法です。

勾配は次のように表されます。

を意味します。

局所最適解で起こる問題

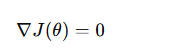

勾配降下法では、勾配がゼロに近づくと探索が停止します。

つまり、

になると、

- 「もう改善できない」

- 「最適解に到達した」

と判断してしまいます。

しかし実際には、それが大域最適解ではなく、単なる局所最適解である可能性があります。

初期値によって結果が変わる理由

機械学習では、パラメータの初期値が非常に重要です。

なぜなら、開始位置によって落ち込む谷が変わるからです。

例えば、

- 初期値A → 局所最適解Aへ収束

- 初期値B → 局所最適解Bへ収束

というように、異なる結果になる場合があります。

これが、

「AIの学習結果が毎回少し違う」

原因の1つです。

深層学習では局所最適解は多いのか?

ニューラルネットワークは非常に高次元な構造を持っています。

そのため誤差関数は複雑になり、

- 多数の谷

- 多数の山

- 平坦な領域

が存在します。

以前は局所最適解が大きな問題と考えられていましたが、現在では、

- 真の問題は「鞍点」

- 局所最適解の多くは十分良い性能を持つ

とも言われています。

とはいえ、最適化の難しさを理解する上で、局所最適解の概念は依然として重要です。

局所最適解を避けるための代表的な手法

現在のAI開発では、局所最適解にハマりにくくするために、さまざまな工夫が行われています。

モーメンタム(Momentum)

勾配に「慣性」を加える手法です。

単純な勾配降下法では停止してしまう場所でも、勢いによって谷を抜けやすくなります。

イメージとしては、

ボールが勢いを保ちながら坂を転がる

ような動きです。

Adam(Adaptive Moment Estimation)

現在もっとも広く使われている最適化アルゴリズムの1つです。

特徴:

- 学習率を自動調整

- モーメンタムを組み合わせる

- 学習を高速化しやすい

- 局所最適解や鞍点から抜けやすい

深層学習フレームワークでも標準的に採用されています。

ノイズを加える方法

学習中にランダムな揺らぎ(ノイズ)を加えることで、局所最適解から抜け出しやすくする方法です。

例えば、

- Dropout

- データ拡張(Data Augmentation)

- ミニバッチ学習

なども、間接的に探索の偏りを減らす効果があります。

局所最適解を理解する重要性

局所最適解の理解は、AIモデルの「なぜ学習が難しいのか」を理解する上で欠かせません。

特に以下の知識につながります。

- なぜ初期値が重要なのか

- なぜ最適化アルゴリズムが必要なのか

- なぜ学習結果が安定しない場合があるのか

- なぜ深層学習では工夫が必要なのか

AIは単純な計算だけでなく、複雑な探索問題を解いているということが見えてきます。

まとめ

局所最適解とは、「周囲では最適に見えるが、全体では最適とは限らない解」のことです。

機械学習や深層学習では、勾配降下法による最適化の途中で局所最適解に到達し、学習が止まってしまう場合があります。

ポイント整理

- 局所最適解は“部分的な最適解”

- 大域最適解は“全体で最良の解”

- 勾配降下法は局所最適解で停止する場合がある

- 初期値によって結果が変わることがある

- モーメンタムやAdamは局所最適解対策として重要

局所最適解の概念を理解することで、AIの最適化アルゴリズムやニューラルネットワーク学習の仕組みを、より深く理解できるようになるでしょう。

こちらもご覧ください:鞍点(Saddle Point)とは?AI・深層学習における問題点と最適化への影響をわかりやすく解説