機械学習やディープラーニングでは、AIモデルが「どれくらい正解に近い予測をしたか」を数値化しながら学習を進めています。

その中でも、画像認識や自然言語処理などの分類問題で特に重要な役割を持つのが「交差エントロピー(Cross Entropy)」です。

交差エントロピーは、AIが出力した「予測確率」と実際の正解とのズレを測定する指標であり、現代のディープラーニングでは最も広く利用されている損失関数の一つです。

本記事では、交差エントロピーの基本概念から、二値分類・多クラス分類との関係、ソフトマックス関数との組み合わせ、なぜ高性能AIに不可欠なのかまでをわかりやすく解説します。

交差エントロピーとは?

交差エントロピーとは、「正解データの確率分布」と「AIモデルが予測した確率分布」の違いを数値化する指標です。

簡単に言えば、

- 正解に近い予測 → 小さい値

- 間違った予測 → 大きい値

を返す仕組みです。

AIは、この値をできるだけ小さくする方向へ学習を進めます。

なぜ「確率分布」を比較するのか?

現代のAIは、単に「正解ラベル」を出力するだけではありません。

たとえば画像認識AIでは、

- 猫:90%

- 犬:7%

- 鳥:3%

のように、「どれくらい自信があるか」も含めて出力します。

交差エントロピーは、この“確信度”まで考慮しながら誤差を評価できる点が大きな特徴です。

交差エントロピーの基本イメージ

もし正解が「猫」だった場合、

- 猫:99% → 誤差は小さい

- 猫:60% → 誤差はやや大きい

- 猫:1% → 誤差は非常に大きい

となります。

つまり、「間違っているうえに、自信満々で誤答している」場合に、強いペナルティを与える仕組みになっています。

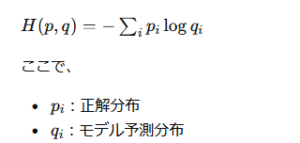

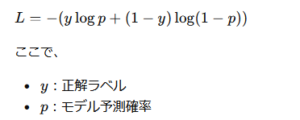

交差エントロピーの数式

交差エントロピーは、確率分布のズレを以下のように表現します。

を表します。

モデルが正解クラスへ高い確率を割り当てるほど、値は小さくなります。

二値分類で使う「Binary Cross Entropy(BCE)」

二値分類とは?

二値分類とは、「Yes / No」のように2つのクラスへ分類する問題です。

例:

- スパムメールかどうか

- 不正アクセスかどうか

- 猫か猫でないか

などがあります。

BCEの特徴

二値分類では「Binary Cross Entropy(BCE)」がよく使われます。

を表します。

BCEは何を評価している?

BCEでは、

- 正解なのに低確率 → 大きな誤差

- 不正解なのに高確率 → 大きな誤差

となります。

つまり、AIが「どれくらい確信を持って間違えたか」を重視しています。

多クラス分類での交差エントロピー

多クラス分類とは?

多クラス分類とは、3種類以上のカテゴリを分類する問題です。

例:

- 犬

- 猫

- 鳥

- 車

など、多数の選択肢から正解を選びます。

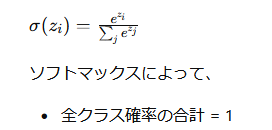

ソフトマックス関数との組み合わせ

多クラス分類では、通常「ソフトマックス関数(Softmax)」を使って出力を確率化します。

になるよう調整されます。

交差エントロピーとの関係

その後、交差エントロピーを用いて、

- 正解クラスの確率が高いか

- 不正解クラスへ過剰な確信を持っていないか

を評価します。

これにより、モデルは効率よく正解方向へ学習できます。

なぜ交差エントロピーは優秀なのか?

学習初期でも強い誤差を与えられる

交差エントロピーは、予測が大きく外れた場合に非常に大きな損失を返します。

そのため、

- 学習初期

- 予測精度が低い段階

でも、モデルを強く修正できます。

これはディープラーニングの高速学習に非常に重要です。

確率的な予測と相性が良い

現代AIは、

- 「どれくらい自信があるか」

- 「確率的にどの程度正しいか」

を扱うケースが多くあります。

交差エントロピーは、そのような確率ベースの予測と非常に相性が良い特徴があります。

交差エントロピーが使われる分野

画像認識

もっとも代表的な用途です。

たとえば、

- 顔認識

- 物体検出

- 医療画像診断

などで利用されています。

自然言語処理(NLP)

文章分類や翻訳AIでも重要です。

例:

- 感情分析

- 文書分類

- 次単語予測

などがあります。

近年の生成AI・LLMでも交差エントロピーは中核的な損失関数です。

音声認識

音声データから、

- 単語

- 音素

- 話者

などを分類する場面でも利用されています。

交差エントロピーと「損失関数」の関係

機械学習では、交差エントロピーを「誤差関数」や「損失関数」として扱います。

つまり、

- 予測がどれくらい間違っているか

- どれくらい改善が必要か

を数値化する役割です。

そのため、

- 交差エントロピー誤差

- 交差エントロピー損失

と呼ばれることもあります。

概念的にはほぼ同じ意味です。

MSEとの違い

回帰問題では「平均二乗誤差(MSE)」が使われます。

しかし分類問題では、交差エントロピーの方が適しています。

MSEの問題点

分類問題でMSEを使うと、

- 学習が遅い

- 勾配が弱くなる

- 確率分布をうまく扱えない

といった問題があります。

交差エントロピーの強み

交差エントロピーは、

- 確率分布に最適化されている

- 勾配が安定しやすい

- 学習効率が高い

ため、現代の分類AIで標準的に使われています。

まとめ

交差エントロピー(Cross Entropy)とは、正解分布とAIの予測分布のズレを測定する指標です。

特に分類問題では非常に重要な損失関数であり、

- 二値分類 → BCE

- 多クラス分類 → Softmax + Cross Entropy

という形で広く利用されています。

また、

- 確率的な予測を評価できる

- 学習効率が高い

- ディープラーニングと相性が良い

という特徴から、現代AIの基盤技術となっています。

画像認識や自然言語処理、生成AIなど、多くの最先端AIシステムは、交差エントロピーによって学習精度を高めています。

こちらもご覧ください:Triplet Loss(トリプレットロス)とは?顔認証・類似検索を支える距離学習の仕組みを解説