機械学習や深層学習を学んでいると、「大域最適解(Global Optimal Solution)」という言葉をよく目にします。

AIモデルの学習では、誤差をできるだけ小さくすることが重要ですが、その際に目指している理想的な答えが「大域最適解」です。

しかし実際のAI開発では、

- なぜ最適化が難しいのか

- なぜ学習結果が毎回異なるのか

- なぜ途中で学習が止まるのか

といった問題が発生します。

これらを理解する上で、「大域最適解」と「局所最適解」の違いは欠かせません。

この記事では、大域最適解の意味や特徴、AI・機械学習で重要視される理由、そして最適化アルゴリズムとの関係について、初心者にもわかりやすく解説します。

大域最適解とは?

大域最適解とは、

「関数全体の中で最も良い値を持つ解」

のことです。

最適化問題では、

- 最大値を求める

- 最小値を求める

という処理が行われますが、その中で“全体を通して最良”の答えが大域最適解になります。

山と谷でイメージする大域最適解

大域最適解は、山や谷の地形で考えると理解しやすくなります。

例えば、「一番低い谷底」を探しているとします。

山の中には、

- 小さな谷

- 深い谷

- 平坦な場所

が複数存在するかもしれません。

その中で、

最も深い谷底

が「大域最適解」です。

局所最適解との違い

大域最適解と混同されやすい概念に「局所最適解(Local Optimal Solution)」があります。

局所最適解とは?

局所最適解は、

周囲では最適だが、全体では最適とは限らない解

を指します。

つまり、一見すると良い答えに見えても、別の場所にさらに良い解が存在する可能性があります。

大域最適解との比較

| 用語 | 意味 |

|---|---|

| 大域最適解 | 関数全体で最も良い解 |

| 局所最適解 | 周囲では最適だが全体では最適とは限らない解 |

AIの学習では、できるだけ大域最適解に近づくことが理想とされています。

機械学習で大域最適解が重要な理由

機械学習では、「損失関数(Loss Function)」という指標を最小化しながら学習を行います。

損失関数とは、

AIの予測ミスの大きさ

を数値化したものです。

つまり、損失が小さいほど精度の高いモデルになります。

勾配降下法と大域最適解

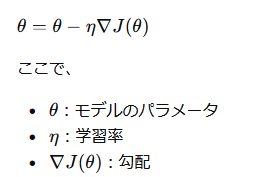

AIでは、「勾配降下法(Gradient Descent)」という最適化手法がよく利用されます。

これは、関数の傾きを利用して少しずつ最小値を探すアルゴリズムです。

更新式は次のように表されます。

を表しています。

勾配降下法は、

「もっと誤差が小さくなる方向」

へ少しずつ移動していく仕組みです。

なぜ大域最適解を見つけるのは難しいのか?

現実の機械学習では、大域最適解を必ず見つけられるとは限りません。

その理由は、誤差関数が非常に複雑だからです。

深層学習は超高次元空間

ニューラルネットワークでは、

- 重み

- バイアス

- 活性化関数

など、多数のパラメータを扱います。

その結果、誤差関数の形状は非常に複雑になります。

イメージとしては、

- 無数の山

- 無数の谷

- 平坦な場所

が入り組んだ巨大な地形です。

そのため、探索途中で局所最適解に入り込んでしまう場合があります。

初期値によって結果が変わる理由

機械学習では、パラメータをランダムに初期化して学習を開始します。

しかし開始地点が異なると、

- 到達する谷

- 学習経路

- 最終結果

が変化します。

つまり、

同じAIモデルでも毎回少し違う結果になる

ことがあります。

これは大域最適解ではなく、異なる局所最適解へ収束しているためです。

大域最適解に近づくための代表的な手法

現在のAIでは、大域最適解にできるだけ近づくために、さまざまな最適化手法が使われています。

モーメンタム(Momentum)

勾配に「慣性」を加える手法です。

小さな谷に引っかかりにくくなるため、局所最適解を抜けやすくなります。

Adam(Adaptive Moment Estimation)

現在もっとも利用されている最適化アルゴリズムの1つです。

特徴:

- 学習率を自動調整

- 勾配の履歴を利用

- 学習が安定しやすい

- 大域最適解へ近づきやすい

深層学習ライブラリでも標準的に採用されています。

ノイズを利用する方法

学習時にランダム性を加えることで、局所最適解から抜け出しやすくする方法です。

例えば、

- ミニバッチ学習

- Dropout

- データ拡張

なども、探索の偏りを抑える効果があります。

大域最適解と鞍点の関係

深層学習では、「鞍点(Saddle Point)」も重要な問題です。

鞍点とは、

- ある方向では谷

- 別方向では山

になっている地点です。

勾配が小さくなるため、最適化が停滞しやすくなります。

以前は局所最適解が最大の問題と考えられていましたが、近年では、

「高次元空間では鞍点の方が多い」

ことがわかっています。

そのため、現在のAI研究では、

- 局所最適解

- 鞍点

の両方を考慮した最適化技術が重要視されています。

実務では「完全な大域最適解」にこだわらない場合もある

実際のAI開発では、理論上の完全な大域最適解を見つけることより、

- 十分高い精度

- 安定した学習

- 実用的な性能

を重視するケースも多くあります。

つまり、

「絶対最強の解」より「実務で十分使える解」

が重要視される場面も少なくありません。

まとめ

大域最適解(Global Optimal Solution)は、関数全体の中で最も良い値を持つ理想的な解です。

機械学習や深層学習では、損失関数を最小化しながら、この大域最適解に近づくことを目指します。

ポイント整理

- 大域最適解は「全体で最良の解」

- 局所最適解は「部分的な最適解」

- 深層学習では誤差関数が非常に複雑

- 勾配降下法は局所最適解に止まる場合がある

- AdamやMomentumは最適化を改善する

- 実務では“十分良い解”も重要

大域最適解の考え方を理解することで、AIモデルの学習や最適化アルゴリズムへの理解がより深まるでしょう。