ディープラーニングでは、モデルを深く複雑にするほど高性能になります。

しかしその一方で、

- 学習が不安定になる

- 勾配消失・勾配爆発が起きる

- 学習速度が低下する

といった問題も発生しやすくなります。

こうした課題を改善するために広く利用されているのが、「バッチ正規化(Batch Normalization)」です。

現在ではCNNやTransformerをはじめ、多くのニューラルネットワークで標準的に利用される重要技術となっています。

本記事では、バッチ正規化の仕組みやメリット、具体的な役割、他の正規化手法との違いまでを初心者向けにわかりやすく解説します。

バッチ正規化(Batch Normalization)とは

バッチ正規化とは、ニューラルネットワーク内部のデータ分布を整え、学習を安定化するための正規化手法です。

英語では「Batch Normalization」と呼ばれ、略して「BatchNorm」や「BN」と表記されることもあります。

ニューラルネットワークでは、各層を通過するたびにデータの値の範囲(スケール)が変化します。

この値のばらつきが大きいと、

- 一部の特徴だけが強調される

- パラメータ更新が不安定になる

- 学習が遅くなる

などの問題が発生します。

バッチ正規化は、こうした値の分布を整えることで、安定した学習を実現します。

なぜバッチ正規化が必要なのか

深層ニューラルネットワークでは、層が深くなるほど値の分布変化が大きくなります。

これによって起きる代表的な問題が、

- 勾配消失

- 勾配爆発

です。

勾配消失とは

誤差逆伝播の途中で勾配が極端に小さくなり、学習が進まなくなる現象です。

勾配爆発とは

逆に勾配が極端に大きくなり、学習が不安定になる現象です。

バッチ正規化は、各層の入力値を適切な範囲に揃えることで、こうした問題を緩和します。

バッチ正規化の仕組み

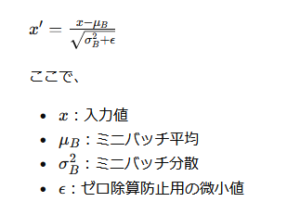

バッチ正規化では、「ミニバッチ単位」で平均と分散を計算します。

そして、特徴量ごとに平均0・分散1へ近づけるよう変換します。

基本的な正規化処理は以下の式で表されます。

を表します。

ミニバッチとは

ミニバッチとは、学習データを小分けにした単位です。

例えば、

- 32枚

- 64枚

- 128枚

などの画像をまとめて学習する場合、その集合をミニバッチと呼びます。

バッチ正規化では、このミニバッチごとに統計量を計算します。

スケール変換と平行移動

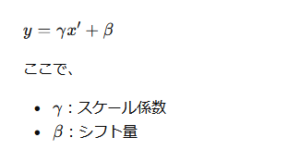

実際のバッチ正規化では、単純に正規化するだけではありません。

学習可能なパラメータを使って、追加調整を行います。

数式では次のようになります。

です。

これによって、必要な情報表現を維持しながら正規化できます。

バッチ正規化のメリット

学習速度が向上する

データ分布が安定することで、最適化が効率化されます。

その結果、

- 学習収束が速くなる

- エポック数削減

などの効果が期待できます。

深いネットワークを学習しやすい

バッチ正規化は、深層モデルで起こりやすい勾配問題を緩和します。

そのため、

- 深いCNN

- 大規模Transformer

などでも安定した学習が可能になります。

過学習を抑えやすい

ミニバッチごとに平均・分散が少し変動するため、ある種のノイズ効果が生まれます。

これが正則化のように働き、過学習抑制につながる場合があります。

学習率を大きく設定しやすい

学習が安定するため、高めの学習率でも訓練しやすくなります。

これは学習高速化に大きく貢献します。

バッチ正規化のデメリット

小バッチ学習に弱い

バッチサイズが小さいと、平均や分散の推定が不安定になります。

その結果、性能が低下する場合があります。

推論時の扱いが複雑

学習時と推論時で使用する統計量が異なるため、実装がやや複雑です。

RNNとの相性問題

時系列モデルでは、バッチ正規化よりもレイヤー正規化が適しているケースがあります。

他の正規化手法との違い

現在では、用途に応じて複数の正規化手法が使い分けられています。

| 手法 | 特徴 | 主な用途 |

|---|---|---|

| バッチ正規化 | ミニバッチ単位で正規化 | CNN |

| レイヤー正規化 | サンプル単位で正規化 | Transformer |

| インスタンス正規化 | チャネル単位で正規化 | 画像生成 |

| グループ正規化 | グループ単位で正規化 | 小バッチ学習 |

バッチ正規化が使われる代表モデル

バッチ正規化は、多くの有名AIモデルで採用されています。

主な採用例

- ResNet

- VGG

- YOLO

- MobileNet

現在の画像認識AIでは、ほぼ標準技術といえる存在です。

バッチ正規化がAI進化に与えた影響

バッチ正規化の登場は、ディープラーニングの発展に大きな影響を与えました。

これにより、

- より深いネットワーク

- 高速学習

- 安定訓練

が実現し、現在の高性能AIにつながっています。

もしバッチ正規化がなければ、現在の大規模ディープラーニングは実現が難しかったとも言われています。

まとめ

バッチ正規化(Batch Normalization)は、ニューラルネットワーク内部の値の分布を整え、学習を安定化するための重要技術です。

ミニバッチ単位で平均と分散を計算し、データを正規化することで、

- 学習速度向上

- 勾配問題の緩和

- 過学習抑制

- 深層モデルの安定化

などの効果をもたらします。

現在ではCNNをはじめ、多くのAIモデルで標準的に利用されており、現代ディープラーニングを支える重要技術の一つとなっています。

こちらもご覧ください:正規化層(Normalization Layer)とは?ニューラルネットワークを安定化する重要技術をわかりやすく解説