AIによる文章生成や音声認識、時系列予測などの技術は、近年大きく進化しています。

これらの技術を支える重要な仕組みの一つが、「回帰結合層(Recurrent Layer)」です。

回帰結合層は、過去の情報を保持しながら次の処理へ活用できる特殊なニューラルネットワーク構造であり、RNN(リカレントニューラルネットワーク)の中核技術として知られています。

本記事では、回帰結合層の基本的な仕組みや特徴、通常のニューラルネットワークとの違い、活用例、課題、LSTMやGRUとの関係までを初心者向けにわかりやすく解説します。

回帰結合層(Recurrent Layer)とは

回帰結合層とは、前回の出力を次回の入力へフィードバックするループ構造を持つニューラルネットワーク層です。

「リカレント層」「再帰層」と呼ばれることもあります。

通常のニューラルネットワークでは、データは一方向に流れます。

入力 → 隠れ層 → 出力一方、回帰結合層では、過去の状態を保持しながら処理を続けます。

入力 → 回帰結合層 → 出力

↑

└── 前回状態これにより、「過去の情報」を考慮した処理が可能になります。

なぜ回帰結合層が必要なのか

順番が重要なデータが存在するため

現実世界には、単独では意味を持たず「順番」が重要なデータが数多く存在します。

代表例は以下です。

- 文章

- 音声

- 動画

- 株価

- センサーデータ

これらは「時系列データ」や「系列データ」と呼ばれます。

文章では文脈理解が必要

例えば、

「私は昨日、映画を見た」

という文章では、「昨日」という情報が後続の意味理解に関係します。

単語を独立して処理するだけでは、自然な文脈理解ができません。

回帰結合層は、前回情報を保持することで文脈を扱えるようにしています。

回帰結合層の仕組み

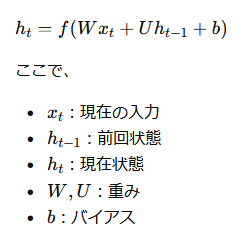

回帰結合層では、

- 現在の入力

- 前回の内部状態

を組み合わせて次の状態を計算します。

基本的な計算式は以下のようになります。

を表します。

つまり、「現在入力」と「過去の記憶」を組み合わせて処理する構造です。

回帰結合層とRNNの関係

回帰結合層は、RNN の基本構成要素です。

RNNは、回帰結合層を時間方向へ繰り返し適用することで動作します。

そのため、

- 過去情報の保持

- 文脈理解

- 時系列予測

などが可能になります。

回帰結合層の特徴

同じ重みを繰り返し利用する

回帰結合層では、各時刻で同じ重みを共有します。

これによって、

- パラメータ数削減

- 学習効率向上

- 可変長入力対応

が実現できます。

可変長データを扱える

文章や音声は長さが一定ではありません。

回帰結合層は、データ長が変わっても処理可能です。

過去情報を保持できる

これが最大の特徴です。

現在だけでなく、過去状態を利用して判断できます。

回帰結合層の活用例

機械翻訳

前後の文脈を考慮しながら翻訳できます。

音声認識

音の流れを考慮して認識できます。

文章生成

前の単語を参考に次単語を予測できます。

時系列予測

- 株価予測

- 需要予測

- センサーデータ分析

などで活用されます。

回帰結合層の課題

回帰結合層には重要な問題も存在します。

勾配消失問題

長い系列を扱うと、誤差逆伝播時に勾配が小さくなりすぎる場合があります。

現在 ← 過去 ← 過去 ← 過去

勾配 小 極小 ほぼ0その結果、

- 古い情報を学習できない

- 長文理解が苦手

- 長期依存関係を扱えない

などの問題が発生します。

勾配爆発問題

逆に勾配が大きくなりすぎる場合もあります。

これを「勾配爆発」と呼びます。

学習不安定化の原因となります。

LSTMによる改善

こうした問題を改善するために開発されたのが、LSTM です。

LSTMでは、

- 記憶する情報

- 忘れる情報

- 出力する情報

を「ゲート機構」で制御します。

これによって、長期記憶を扱いやすくなりました。

GRUによる簡略化

GRU は、LSTMを簡略化したモデルです。

特徴として、

- 計算量削減

- 高速学習

- 実装容易

などがあります。

現在でも多くの時系列AIで利用されています。

Transformer時代との関係

現在の自然言語処理では、Transformer が主流です。

Transformerは、

- 並列計算が可能

- 長距離依存に強い

- 学習高速

などの特徴を持っています。

現在の

- GPT

- BERT

などもTransformerベースです。

それでも回帰結合層が重要な理由

現在でも回帰結合層は重要です。

特に、

- 軽量時系列モデル

- 組み込みAI

- リアルタイム制御

- 小規模データ処理

などでは依然として活用されています。

また、RNN系モデルを理解する基礎として欠かせません。

まとめ

回帰結合層(Recurrent Layer)は、前回の出力を次回入力へフィードバックするループ構造を持つニューラルネットワーク層です。

この仕組みにより、

- 文脈理解

- 時系列解析

- 過去情報の保持

が可能になります。

特に、

- RNN

- LSTM

- GRU

などのモデルの基盤技術として重要な役割を果たしています。

現在はTransformerが主流となっていますが、回帰結合層は時系列AIの発展を支えた重要技術であり、深層学習を理解するうえで欠かせない概念といえるでしょう。

こちらもご覧ください:RNN(リカレントニューラルネットワーク)とは?時系列データを扱う深層学習モデルをわかりやすく解説