AIやディープラーニングの発展により、機械翻訳や音声認識、文章生成などの技術は急速に進化しました。

その基盤技術の一つとして重要な役割を果たしたのが、「RNN(Recurrent Neural Network:リカレントニューラルネットワーク)」です。

RNNは、文章や音声のような「順番に意味があるデータ」を扱うために開発されたニューラルネットワークであり、現在の生成AI技術にも大きな影響を与えています。

本記事では、RNNの基本構造から仕組み、特徴、活用例、LSTMやGRUとの関係までを初心者向けにわかりやすく解説します。

RNN(リカレントニューラルネットワーク)とは

RNN(Recurrent Neural Network)とは、過去の情報を保持しながらデータを処理できるニューラルネットワークです。

通常のニューラルネットワークでは、入力から出力へ一方向にデータが流れます。

入力 → 隠れ層 → 出力一方、RNNでは「前回の状態」を次回の計算へ引き継ぐループ構造を持っています。

入力 → RNNセル → 出力

↑

└── 前回状態これにより、「過去の情報」を考慮した処理が可能になります。

なぜRNNが必要なのか

通常のニューラルネットワークの弱点

通常のニューラルネットワークは、各入力を独立したデータとして扱います。

しかし、現実には「順番」が重要なデータが数多く存在します。

例えば、

- 文章

- 音声

- 動画

- 株価

- センサーデータ

などです。

文章では文脈が重要

例えば、

「私は昨日、映画を見に行った。」

という文章では、「昨日」という情報が後続の意味理解に影響します。

単語をバラバラに処理すると、文脈を理解できません。

RNNは過去情報を保持することで、こうした文脈を扱えるようにしました。

RNNの基本的な仕組み

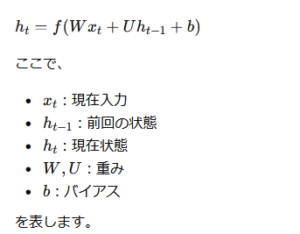

RNNでは、各時刻の入力と過去状態を組み合わせて次の状態を計算します。

基本式は以下のように表されます。

ht=f(Wxt+Uht−1+b)h_t = f(Wx_t + Uh_{t-1} + b)

ここで、

つまり、「現在入力」と「過去記憶」を組み合わせて処理する仕組みです。

RNNが得意なデータ

時系列データ

RNNは、時間順に変化するデータに強みを持ちます。

例えば、

- 株価予測

- 天気予測

- IoTセンサーデータ分析

などです。

自然言語処理

文章は単語の順番が重要です。

RNNは、

- 文脈理解

- 次単語予測

- 翻訳

などで大きな成果を上げました。

音声認識

音声も時間方向に変化するデータです。

RNNは音素の流れを考慮できるため、音声認識でも利用されました。

RNNのメリット

文脈を考慮できる

過去情報を保持できるため、順序情報を扱えます。

可変長入力に対応できる

文章の長さが変わっても処理可能です。

時系列データに強い

時間的依存関係を学習できます。

RNNの問題点

RNNは画期的な技術でしたが、欠点もありました。

勾配消失問題

RNNでは誤差逆伝播を時間方向にも繰り返します。

その結果、系列が長くなると勾配が極端に小さくなることがあります。

現在 ← 過去 ← 過去 ← 過去

勾配 小 極小 ほぼ0これを「勾配消失問題」と呼びます。

長期記憶の学習が困難になる原因です。

勾配爆発問題

逆に勾配が大きくなりすぎる場合もあります。

これが「勾配爆発」です。

学習が不安定になる原因となります。

LSTMとは

RNNの問題を改善した代表技術が「LSTM(Long Short-Term Memory)」です。

LSTM は、

- 忘れる情報

- 保持する情報

- 出力する情報

を制御する「ゲート機構」を持っています。

これにより、長期依存関係を学習しやすくなりました。

GRUとは

LSTMをさらに簡略化したものが、GRU です。

GRUは、

- 計算量が少ない

- 学習が高速

- 実装が比較的簡単

という特徴があります。

現在でも多くの時系列モデルで利用されています。

RNNの活用例

機械翻訳

文章の流れを考慮しながら翻訳できます。

音声認識

発音の時間的変化を学習できます。

文章生成

次に来る単語を予測できます。

時系列予測

株価や需要予測などに利用されます。

Transformer登場による変化

近年では、Transformer の登場により、自然言語処理の主流はRNNからTransformerへ移行しました。

Transformerは、

- 並列計算可能

- 長距離依存を扱いやすい

- 学習速度が速い

などの利点があります。

現在の

- BERT

- GPT

などの大規模言語モデルもTransformerベースです。

それでもRNNが重要な理由

現在でもRNNは重要な基礎技術です。

特に、

- 小規模時系列処理

- 軽量モデル

- リアルタイム制御

- 組み込みAI

では利用され続けています。

また、LSTMやGRUは現在も多くの実務で使われています。

RNNとCNNの違い

| 項目 | RNN | CNN |

|---|---|---|

| 得意分野 | 時系列データ | 画像データ |

| 主な用途 | NLP・音声・予測 | 画像認識 |

| 特徴 | 過去情報を保持 | 空間特徴を抽出 |

まとめ

RNN(リカレントニューラルネットワーク)は、過去の情報を保持しながら処理を行うニューラルネットワークです。

特に、

- 文章

- 音声

- 動画

- 時系列データ

の処理に強みを持っています。

また、

- LSTM

- GRU

といった発展モデルによって、長期依存問題も大きく改善されました。

現在のAIではTransformerが主流になっていますが、RNNは現代深層学習の基礎を築いた極めて重要な技術であり、今なお多くの分野で活用されています。

こちらもご覧ください:スキップ接続(Skip Connection)とは?深層学習の勾配消失を解決した重要技術をわかりやすく解説