ディープラーニングでは、学習を安定させるために「正規化(Normalization)」という技術が重要な役割を果たしています。

その中でも近年注目されているのが、「グループ正規化(Group Normalization)」です。

グループ正規化は、CNN(畳み込みニューラルネットワーク)の特徴マップを複数のチャネルグループ単位で正規化する手法であり、特に小バッチ学習環境で高い効果を発揮します。

本記事では、グループ正規化の仕組みや特徴、バッチ正規化との違い、メリット・デメリット、活用シーンまでを初心者向けにわかりやすく解説します。

グループ正規化(Group Normalization)とは

グループ正規化とは、ニューラルネットワーク内部の特徴量を「チャネルグループ単位」で正規化する手法です。

英語では「Group Normalization」と呼ばれ、略して「GN」と表記されることがあります。

CNNでは、画像から抽出された特徴が「特徴マップ」として出力されます。

各フィルタの出力は「チャネル」と呼ばれ、異なる特徴を表現しています。

グループ正規化では、この複数のチャネルをいくつかのグループに分割し、グループごとに平均と分散を計算して正規化を行います。

なぜ正規化が必要なのか

ニューラルネットワークでは、層が深くなるにつれてデータ分布が変化します。

この値のばらつきが大きくなると、

- 学習が不安定になる

- 勾配消失・勾配爆発が起こる

- 特定特徴だけが強調される

などの問題が発生します。

正規化は、こうした問題を抑え、学習を安定化するために利用されます。

グループ正規化の仕組み

グループ正規化では、1つのサンプル内部のチャネルを複数グループへ分割します。

例えば、

- 64チャネル

- 8グループ

であれば、1グループあたり8チャネルをまとめて正規化します。

各グループごとに平均と分散を計算し、値を調整します。

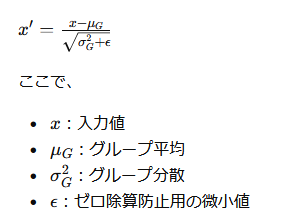

基本的な正規化式は次のようになります。

を表します。

グループ正規化の特徴

バッチサイズに依存しない

グループ正規化は、1サンプル内部だけで統計量を計算します。

そのため、バッチサイズの影響をほとんど受けません。

これはバッチ正規化との大きな違いです。

チャネルを適度にまとめて扱う

グループ正規化は、

- レイヤー正規化

- インスタンス正規化

の中間的な存在ともいえます。

インスタンス正規化・レイヤー正規化との関係

グループ数を変えることで、他の正規化手法に近づきます。

グループ数 = チャネル数

各チャネルを独立して正規化するため、インスタンス正規化と同じになります。

グループ数 = 1

全チャネルをまとめて正規化するため、レイヤー正規化と同じになります。

正規化手法の比較

| 手法 | 正規化単位 | 特徴 |

|---|---|---|

| バッチ正規化 | ミニバッチ | CNNで主流 |

| レイヤー正規化 | 全チャネル | Transformer向け |

| インスタンス正規化 | チャネル単位 | 画像生成向け |

| グループ正規化 | チャネルグループ | 小バッチCNN向け |

なぜ小バッチ学習で有効なのか

バッチ正規化では、ミニバッチ全体から平均・分散を計算します。

そのため、バッチサイズが小さいと統計量が不安定になります。

一方、グループ正規化はサンプル単位で動作するため、

- バッチサイズ1

- GPUメモリ制約環境

- 高解像度画像処理

などでも安定した性能を発揮しやすいのです。

グループ正規化のメリット

小バッチ環境で安定する

最も大きなメリットです。

特に大規模画像処理ではGPUメモリ制限から小バッチになりやすく、グループ正規化が有効です。

学習を安定化できる

値のばらつきを抑えることで、

- 勾配安定化

- 学習高速化

- 過学習抑制

などの効果が期待できます。

柔軟に調整できる

グループ数を調整することで、モデル特性に合わせた最適化が可能です。

グループ正規化のデメリット

グループ数の調整が必要

グループ数はハイパーパラメータです。

適切な値を探すために、

- 実験

- チューニング

- 計算時間

が必要になる場合があります。

バッチ正規化より遅い場合もある

GPU最適化の関係で、環境によってはBatchNormの方が高速なケースもあります。

用途によっては効果が限定的

大規模バッチ学習では、バッチ正規化の方が有利な場合もあります。

グループ正規化が活躍する場面

グループ正規化は、特に小バッチCNNで有効です。

主な活用例

- 高解像度画像認識

- 医療画像AI

- 物体検出

- セグメンテーション

- 小型GPU環境

などで利用されています。

グループ正規化が使われる代表的モデル

現在では、多くのCNN系モデルで利用されています。

主な採用例

- Mask R-CNN

- Detectron2

- ResNet

特に物体検出や画像分割分野で重要な技術です。

実務での重要性

近年のAI開発では、

- 高解像度画像

- 3Dデータ

- 医療画像

など、メモリ消費の大きいデータを扱う機会が増えています。

その結果、大きなバッチサイズを確保できないケースも多く、グループ正規化の重要性が高まっています。

まとめ

グループ正規化(Group Normalization)は、チャネルを複数グループに分けて正規化を行う技術です。

特に、

- 小バッチ学習

- 高解像度画像処理

- GPUメモリ制約環境

で高い効果を発揮します。

また、

- インスタンス正規化

- レイヤー正規化

の中間的な特徴を持つ柔軟な手法でもあります。

現在の画像認識AIや物体検出AIを支える重要な技術の一つであり、CNNを深く理解するうえで押さえておきたい正規化技術といえるでしょう。

こちらもご覧ください:レイヤー正規化(Layer Normalization)とは?Transformer時代に重要な正規化技術をわかりやすく解説