AIによる文章生成や音声認識、時系列予測などの技術は、近年大きく進化しています。

これらの技術を支える重要な仕組みの一つが、「回帰結合層(Recurrent Layer)」です。

回帰結合層は、過去の情報を保持しながら次の処理へ活用できる特殊なニューラルネットワーク構造であり、RNN(リカレントニューラルネットワーク)の中核技術として知られています。

その中でも「ジョルダンネットワーク(Jordan Network)」は、RNNの初期モデルとして有名な構造です。

本記事では、ジョルダンネットワークの仕組みや特徴、エルマンネットワークとの違い、活用例、RNN発展史における位置づけまでを初心者向けにわかりやすく解説します。

ジョルダンネットワークとは

ジョルダンネットワークとは、前回の「最終出力」を次回入力へフィードバックする構造を持つRNN(リカレントニューラルネットワーク)の一種です。

通常のニューラルネットワークでは、データは入力層から出力層へ一方向に流れます。

入力 → 隠れ層 → 出力しかしジョルダンネットワークでは、前回の出力結果を「コンテキスト層(Context Layer)」へ保存し、次回入力時に利用します。

入力 → 隠れ層 → 出力

↑ ↓

└── コンテキスト層 ──┘これによって、過去の結果を踏まえた時系列処理が可能になります。

なぜジョルダンネットワークが重要なのか

過去の出力結果を記憶できるため

時系列データでは、現在の処理に過去結果が大きく影響します。

例えば以下のようなケースです。

- 音声認識

- 会話システム

- 文章生成

- 株価予測

- ロボット制御

これらでは「直前に何を出力したか」が重要になります。

ジョルダンネットワークは、前回の最終出力を記憶することで、文脈や状態変化を考慮した処理を可能にしました。

コンテキスト層とは

ジョルダンネットワークの特徴が「コンテキスト層」です。

コンテキスト層は、前回出力を一時的に保存するメモリのような役割を持っています。

流れを簡単に整理すると以下です。

- 現在入力を処理

- 出力を生成

- 出力をコンテキスト層へ保存

- 次回入力時にその情報を利用

この仕組みにより、過去情報を継続的に利用できます。

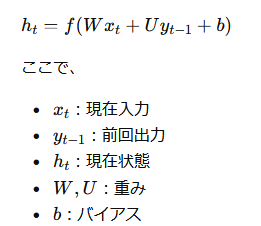

ジョルダンネットワークの仕組み

ジョルダンネットワークでは、

- 現在の入力

- 前回の出力情報

を組み合わせて次の出力を計算します。

概念的には以下のようになります。

を表します。

通常のRNNと似ていますが、「前回の最終出力」を利用する点が特徴です。

エルマンネットワークとの違い

ジョルダンネットワークと比較される代表的なモデルが、「エルマンネットワーク(Elman Network)」です。

ジョルダンネットワーク

- 前回の「出力」を保存

- 結果ベースの記憶

- 行動結果を重視

エルマンネットワーク

- 隠れ層の状態を保存

- 中間状態を記憶

- 文脈情報を重視

違いを簡単に比較

| 項目 | ジョルダンネットワーク | エルマンネットワーク |

|---|---|---|

| 保存対象 | 出力層 | 隠れ層 |

| 記憶内容 | 最終結果 | 内部状態 |

| 得意分野 | 制御・予測 | 自然言語処理 |

| 文脈保持 | やや弱い | 比較的強い |

エルマンネットワークは、文章の途中状態を保持しやすいため、自然言語処理分野で広く研究されました。

ジョルダンネットワークの活用例

音声認識

過去発音結果を考慮して次音声を認識できます。

時系列予測

過去予測結果を利用して次の値を予測します。

例:

- 株価予測

- 気象予測

- センサーデータ分析

制御システム

ロボット制御などで、前回行動結果を次動作へ反映できます。

ジョルダンネットワークの課題

ジョルダンネットワークは画期的でしたが、問題点も存在しました。

長期記憶が苦手

系列が長くなると、古い情報を保持しにくくなります。

これはRNN全般の問題でもあります。

勾配消失問題

誤差逆伝播時に勾配が極端に小さくなる現象です。

現在 ← 過去 ← 過去 ← 過去

勾配 小 極小 ほぼ0これによって長期依存関係の学習が難しくなります。

LSTM・GRUへの発展

こうした問題を改善するために登場したのが、

- LSTM

- GRU

です。

これらは「ゲート機構」を導入することで、

- 必要情報を保持

- 不要情報を忘却

できるようになりました。

現在のRNN系技術の主流は、LSTMやGRUとなっています。

Transformer時代との関係

現在の自然言語処理では、Transformer が主流です。

Transformerは、

- 並列処理可能

- 長距離依存に強い

- 学習高速

などの特徴を持っています。

そのため、

- GPT

- BERT

などもTransformerベースになっています。

それでもジョルダンネットワークを学ぶ意味

現在は最新モデルではありませんが、ジョルダンネットワークはRNN発展史を理解するうえで非常に重要です。

特に、

- 時系列AIの基礎理解

- フィードバック構造の理解

- メモリ機構の理解

に役立ちます。

現代AIを学ぶ上でも、基礎概念として知っておく価値があります。

まとめ

ジョルダンネットワーク(Jordan Network)は、前回の出力結果をコンテキスト層へ保存し、次回入力へ反映するRNNの一種です。

この構造によって、

- 過去結果を考慮した処理

- 時系列データ解析

- 文脈を踏まえた予測

が可能になります。

一方で、

- 勾配消失

- 長期記憶の難しさ

といった課題もあり、後に

- LSTM

- GRU

へと発展していきました。

現在はTransformerが主流となっていますが、ジョルダンネットワークはRNNの基礎を築いた重要なモデルとして、今なおAI学習において価値の高い概念です。

こちらもご覧ください:回帰結合層(Recurrent Layer)とは?RNNの中核となる仕組みをわかりやすく解説