ディープラーニングでは、ニューラルネットワーク内部のデータ分布を安定させるために「正規化(Normalization)」という技術が広く利用されています。

その中でも、自然言語処理や生成AIで特に重要な役割を担っているのが「レイヤー正規化(Layer Normalization)」です。

近年注目されているTransformer系AIでは、レイヤー正規化がほぼ標準的に採用されています。

本記事では、レイヤー正規化の仕組みや特徴、バッチ正規化との違い、Transformerとの関係、メリット・デメリットまでを初心者向けにわかりやすく解説します。

レイヤー正規化(Layer Normalization)とは

レイヤー正規化とは、ニューラルネットワークの各サンプルに対して、層内部の値を正規化する手法です。

英語では「Layer Normalization」と呼ばれ、略して「LayerNorm」や「LN」と表記されることがあります。

ニューラルネットワークでは、層を通過するたびにデータのスケールが変化します。

値のばらつきが大きくなると、

- 学習が不安定になる

- 勾配消失・勾配爆発が起きる

- 学習速度が低下する

といった問題が発生します。

レイヤー正規化は、こうした問題を抑えるために利用されます。

レイヤー正規化の仕組み

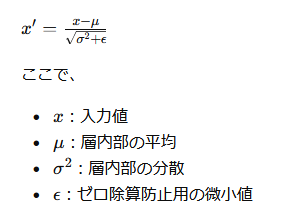

レイヤー正規化では、「1つのサンプル内部」に含まれる特徴量全体の平均と分散を計算します。

その後、各値を正規化して、平均0・分散1に近づけます。

基本的な計算式は次のようになります。

を表します。

バッチ正規化との違い

レイヤー正規化とよく比較されるのが「バッチ正規化(Batch Normalization)」です。

両者は「どの単位で統計量を計算するか」が大きく異なります。

バッチ正規化の場合

バッチ正規化では、複数サンプルをまとめた「ミニバッチ単位」で平均と分散を計算します。

そのため、バッチサイズが小さいと統計量が不安定になることがあります。

レイヤー正規化の場合

レイヤー正規化は、各サンプルを独立して処理します。

つまり、他のデータに依存せず、1つのサンプル内部だけで正規化が完結します。

比較表

| 項目 | レイヤー正規化 | バッチ正規化 |

|---|---|---|

| 正規化単位 | サンプル単位 | ミニバッチ単位 |

| バッチサイズ依存 | ほぼなし | あり |

| 得意分野 | NLP・Transformer | CNN |

| 小バッチ学習 | 強い | 不安定になりやすい |

なぜTransformerで重要なのか

レイヤー正規化は、特にTransformerアーキテクチャで重要な技術です。

Transformerでは、

- 可変長テキスト

- 時系列データ

- 長文入力

などを扱います。

このようなデータでは、バッチサイズが一定にならないことも多く、バッチ正規化が扱いにくい場合があります。

その点、レイヤー正規化はサンプル単位で動作するため、Transformerとの相性が非常に良いのです。

RNNでも有効な理由

レイヤー正規化は、RNN(再帰型ニューラルネットワーク)でも利用されます。

RNNは、

- 文章

- 音声

- 時系列データ

など、順番を持つデータを処理します。

時系列データは入力長が変化しやすいため、バッチ正規化よりもレイヤー正規化が安定しやすいケースがあります。

レイヤー正規化のメリット

バッチサイズに依存しない

レイヤー正規化最大の利点は、小バッチでも安定することです。

バッチサイズ1でも問題なく動作できます。

学習が安定しやすい

値のばらつきを抑えることで、

- 勾配安定化

- 学習高速化

- 収束改善

などの効果が期待できます。

Transformerとの相性が良い

現在の生成AI・大規模言語モデルでは、レイヤー正規化がほぼ必須技術となっています。

レイヤー正規化のデメリット

CNNでは最適とは限らない

画像認識CNNでは、バッチ全体の統計量を使うバッチ正規化の方が性能が高い場合があります。

計算コストが増える

平均・分散計算を毎回行うため、若干の追加計算が必要です。

タスクによって効果が異なる

すべてのニューラルネットワークで万能というわけではありません。

用途に応じた使い分けが重要です。

インスタンス正規化・グループ正規化との違い

正規化手法には複数の種類があります。

インスタンス正規化(Instance Normalization)

チャネルごとに独立して正規化する手法です。

主に画像生成AIで利用されます。

グループ正規化(Group Normalization)

チャネルを複数グループに分けて正規化します。

小バッチCNNで有効です。

正規化手法の比較

| 手法 | 正規化対象 | 主な用途 |

|---|---|---|

| バッチ正規化 | ミニバッチ | CNN |

| レイヤー正規化 | サンプル全体 | Transformer・RNN |

| インスタンス正規化 | チャネル単位 | 画像生成 |

| グループ正規化 | チャネルグループ | 小バッチCNN |

レイヤー正規化が使われる代表的AIモデル

レイヤー正規化は、現在の生成AIを支える重要技術です。

主な採用例

- Transformer

- BERT

- GPT

- T5

特に大規模言語モデル(LLM)では不可欠な存在となっています。

生成AI時代における重要性

現在のChatGPTのような生成AIは、巨大なTransformerモデルをベースにしています。

その安定学習を支えているのが、レイヤー正規化です。

もしレイヤー正規化がなければ、

- 深いTransformer

- 大規模言語モデル

- 長文処理AI

の実現は非常に難しかったと考えられています。

まとめ

レイヤー正規化(Layer Normalization)は、サンプル単位でニューラルネットワーク内部の値を正規化する技術です。

特に、

- Transformer

- RNN

- 大規模言語モデル

などで重要な役割を果たしています。

バッチサイズに依存しないため、

- 小バッチ学習

- 可変長データ

- 時系列処理

に強いという特徴があります。

現在の生成AIを支える基盤技術の一つであり、ディープラーニングを理解するうえで欠かせない重要概念といえるでしょう。

こちらもご覧ください:インスタンス正規化(Instance Normalization)とは?CNNや画像生成AIで重要な役割をわかりやすく解説