AIによる文章生成、音声認識、機械翻訳などの分野では、「時系列データ」を効率よく扱うことが重要です。

こうした技術の発展を支えているのが、RNN(リカレントニューラルネットワーク)やLSTM、GRUといった系列モデルです。

その中でも、長期的な情報を保持しながら不要な情報を制御するために重要な役割を果たしているのが「ゲート機構(Gating Mechanism)」です。

ゲート機構は、情報の流れを調整することで、従来のRNNが抱えていた「勾配消失問題」や長期依存関係の学習難易度を大きく改善しました。

本記事では、ゲート機構の基本的な考え方や役割、LSTM・GRUでの利用方法、メリット、活用例までを初心者向けにわかりやすく解説します。

ゲート機構とは

ゲート機構とは、ニューラルネットワーク内部で「どの情報を通し、どの情報を遮断するか」を制御する仕組みです。

特に、

- RNN

- LSTM

- GRU

などの時系列モデルで重要な役割を果たします。

人間も会話の中で、

- 必要な情報は覚える

- 不要な情報は忘れる

という処理を自然に行っています。

ゲート機構は、これに近い情報制御をニューラルネットワーク上で実現する仕組みと言えます。

なぜゲート機構が必要なのか

RNNの弱点「勾配消失問題」

通常のRNNでは、過去情報を保持しながら学習を行います。

しかし、系列が長くなると過去の情報が徐々に失われる問題がありました。

これを「勾配消失問題」と呼びます。

例えば、

数十単語前の情報

↓

現在の予測時には影響が弱くなるという現象が起きます。

不要情報まで保持してしまう問題

RNNはすべての情報を均等に扱いやすいため、

- 重要情報

- 不要情報

を適切に区別しにくい欠点もありました。

そこで登場したのがゲート機構です。

ゲート機構の基本的な役割

ゲート機構は、主に以下のような役割を持ちます。

- 情報を保持する

- 情報を忘れる

- 情報を出力する

- 情報の重要度を判断する

つまり、「情報の交通整理」を行う仕組みです。

ゲート機構のイメージ

ゲート機構は、以下のような流れで動作します。

入力情報

↓

[ゲート]

↓

必要情報だけ通過

↓

次の処理へ重要な情報のみを選別することで、長期記憶性能を高めています。

LSTMにおけるゲート機構

ゲート機構が最も有名なのは、LSTM(Long Short-Term Memory)です。

LSTMには以下の3種類のゲートがあります。

- 入力ゲート

- 忘却ゲート

- 出力ゲート

さらに「記憶セル」と呼ばれる長期記憶領域を持っています。

入力ゲート

新しい情報をどれだけ記憶するかを決定します。

忘却ゲート

不要になった情報を削除します。

出力ゲート

記憶情報のうち、どれを出力するかを制御します。

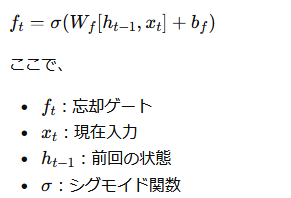

忘却ゲートの数式例

LSTMでは、忘却ゲートによって情報保持量を制御します。

代表的な式は以下です。

を表します。

シグモイド関数によって、情報を「残す」「忘れる」を0〜1で調整しています。

GRUにおけるゲート機構

GRU は、LSTMを簡略化したモデルです。

GRUでは、以下の2種類のゲートを利用します。

- 更新ゲート

- リセットゲート

LSTMより構造がシンプルなため、計算量を抑えやすい特徴があります。

ゲート機構のメリット

長期依存関係を学習しやすい

遠い過去の情報を保持しやすくなります。

勾配消失を軽減できる

情報を適切に保持することで、勾配消失問題を改善します。

学習が安定する

不要情報を除去できるため、ノイズの影響を受けにくくなります。

ゲート機構の活用分野

自然言語処理

文章では前後関係が重要です。

そのためゲート機構は、

- 機械翻訳

- チャットボット

- 要約

- 感情分析

などで活躍しています。

音声認識

音声は時間的な連続性を持つため、ゲート機構が有効です。

時系列予測

以下のような分野でも利用されています。

- 株価予測

- 需要予測

- IoTデータ解析

- 異常検知

Transformerとの違い

現在主流のTransformer は、基本的にはLSTM型のゲート機構を中心には使っていません。

代わりに「Attention(注意機構)」を利用しています。

ただし、

- 情報の重要度を選択する

- 必要情報を強調する

という考え方は、ゲート機構と共通しています。

ゲート機構は現代AIの基礎技術

現在の大規模言語モデルではTransformerが主流ですが、ゲート機構は依然として重要です。

特に、

- 軽量モデル

- リアルタイム処理

- 時系列予測

では現在も広く利用されています。

また、LSTMやGRUを理解することは、現代AIの進化を理解するうえで非常に役立ちます。

まとめ

ゲート機構(Gating Mechanism)は、ニューラルネットワーク内部で情報の流れを制御する重要技術です。

特にLSTMやGRUでは、

- 必要情報を保持

- 不要情報を削除

- 出力情報を選択

することで、長期的な文脈を効率よく学習できます。

これにより、

- 勾配消失問題の改善

- 学習安定化

- 長期依存関係の理解

が可能となりました。

現在はTransformerが主流となっていますが、ゲート機構は時系列AIの発展を支えた重要な基盤技術であり、深層学習を理解するうえで欠かせない知識と言えるでしょう。

こちらもご覧ください:教師強制(Teacher Forcing)とは?RNNやTransformerの学習を安定化する重要技術をわかりやすく解説