AIによる文章生成、音声認識、翻訳、需要予測など、近年の人工知能技術では「時系列データ」を扱う場面が非常に増えています。

こうした分野で重要な役割を果たしてきたのが、RNN(リカレントニューラルネットワーク)です。

しかし、従来のRNNには「長い系列を学習しづらい」という課題がありました。

この問題を改善するために開発された代表的な技術が、LSTM(Long Short-Term Memory)とGRU(Gated Recurrent Unit)です。

その中でもGRUは、LSTMよりもシンプルな構造を持ちながら高い性能を実現できることから、多くのAIシステムで利用されています。

本記事では、GRUの基本的な仕組みや特徴、RNNやLSTMとの違い、活用例、メリット・デメリットまでを初心者向けにわかりやすく解説します。

GRUとは

GRU(Gated Recurrent Unit)は、RNNを改良したニューラルネットワーク構造の一種です。

RNNは、過去の情報を保持しながらデータを処理できる特徴を持っています。

例えば、

- 文章

- 音声

- 動画

- センサーデータ

- 株価

など、「順番」や「時間の流れ」が重要なデータを扱うことが可能です。

GRUは、このRNNの記憶能力を強化しつつ、計算量を削減するために設計されました。

なぜGRUが必要だったのか

RNNの課題「勾配消失問題」

通常のRNNでは、長い系列データを扱うと過去情報が徐々に失われることがあります。

これは、学習時に誤差が過去へ伝わるにつれて小さくなってしまうためです。

この現象を「勾配消失問題」と呼びます。

例えば、

「昨日食べた料理は…とても美味しかった」のような長い文章では、文頭の情報を後半まで保持しづらくなります。

重み衝突問題

RNNでは同じ重みを時系列全体で共有します。

しかし、

- 今だけ重要な情報

- 長期的に重要な情報

を同時に扱う必要があるため、学習が難しくなる場合があります。

これを「重み衝突」と呼びます。

GRUの基本構造

GRUは、LSTMを簡略化した構造です。

LSTMでは複数のゲートと記憶セルを使いますが、GRUでは以下の2つのゲートのみを使用します。

- 更新ゲート(Update Gate)

- リセットゲート(Reset Gate)

構造をシンプルにすることで、高速かつ効率的な学習を実現しています。

更新ゲートとは

更新ゲートは、「過去の情報をどれだけ残すか」を制御する役割を持ちます。

重要な過去情報は維持し、不要な情報は新しい入力で上書きします。

リセットゲートとは

リセットゲートは、「過去情報をどれだけ無視するか」を制御します。

例えば、新しい文脈に切り替わった場合、古い情報をリセットして新しい情報を優先できます。

GRUのイメージ

GRUは、以下のような情報制御を行います。

過去情報

↓

[更新ゲート]

↓

必要情報を保持

現在入力

↓

[リセットゲート]

↓

不要情報を除去この仕組みによって、長期的な文脈を効率的に扱えるようになります。

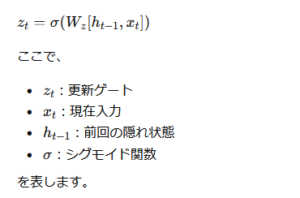

GRUの基本数式

GRUでは、更新ゲートが重要な役割を担います。

代表的な更新ゲートの式は以下です。

を表します。

この値によって、「どれだけ過去情報を保持するか」が決まります。

LSTMとの違い

GRUは、LSTMをよりシンプルにした構造と考えられています。

LSTMの特徴

LSTMは、

- 記憶セル

- 入力ゲート

- 出力ゲート

- 忘却ゲート

を持つ複雑な構造です。

長期記憶性能に優れていますが、計算コストが高いという欠点があります。

GRUの特徴

GRUは、

- 記憶セルなし

- ゲート数削減

- パラメータ削減

によって軽量化されています。

LSTMとGRUの比較

| 項目 | LSTM | GRU |

|---|---|---|

| 構造 | 複雑 | シンプル |

| ゲート数 | 3種類 | 2種類 |

| 記憶セル | あり | なし |

| 計算量 | 多い | 少ない |

| 学習速度 | やや遅い | 比較的高速 |

| 長期記憶性能 | 高い | 高い |

実際には、用途やデータ量によって使い分けられます。

GRUのメリット

学習速度が速い

パラメータ数が少ないため、LSTMより高速に学習しやすい特徴があります。

計算コストを抑えられる

モデルが軽量なため、

- モバイルAI

- 組み込み機器

- リアルタイム処理

との相性が良好です。

小規模データでも扱いやすい

データ量が少ない環境では、GRUのほうが安定する場合があります。

GRUのデメリット

超長期依存ではLSTMに劣る場合がある

非常に長い文脈を扱う場合は、LSTMのほうが有利になるケースがあります。

Transformerに比べると古典的

現在の大規模AIでは、Transformer が主流になっています。

特に、

- GPT

- BERT

などはTransformerベースです。

ただし、GRUは軽量性の高さから現在でも多く利用されています。

GRUの主な活用例

自然言語処理

- チャットボット

- 文章分類

- 翻訳

- 感情分析

などで利用されます。

音声認識

音声は時間的な流れを持つため、GRUと相性が良い分野です。

時系列予測

以下のような予測分野でも活用されています。

- 株価予測

- 需要予測

- IoTデータ解析

- 異常検知

まとめ

GRU(Gated Recurrent Unit)は、RNNの勾配消失問題や重み衝突問題を改善するために開発された時系列ニューラルネットワークです。

LSTMよりもシンプルな構造を採用しながら、高い性能を維持できる点が大きな特徴です。

特に、

- 高速学習

- 軽量モデル

- リアルタイム処理

に強みがあり、現在でも多くのAI分野で活用されています。

Transformerが主流となった現在でも、GRUは時系列AIの基礎技術として非常に重要な存在であり、深層学習を理解するうえで欠かせないモデルの一つです。

こちらもご覧ください:LSTM(Long Short-Term Memory)とは?RNNの弱点を克服した時系列AI技術をわかりやすく解説