AIによる文章生成、音声認識、機械翻訳、株価予測などの技術は、近年大きく進化しています。

こうした「時間の流れ」を持つデータを扱うAI技術の基盤となったのが、RNN(リカレントニューラルネットワーク)です。

しかし、初期のRNNには「長い文章になると過去情報を忘れてしまう」という大きな課題がありました。

この問題を解決するために登場したのが、「LSTM(Long Short-Term Memory)」です。

LSTMは、必要な情報を長期間保持しながら、不要な情報を適切に忘れる仕組みを持つニューラルネットワーク構造であり、自然言語処理や時系列解析の発展に大きく貢献しました。

本記事では、LSTMの仕組みや特徴、RNNとの違い、ゲート構造、活用例、GRUとの比較、Transformerとの関係までを初心者向けにわかりやすく解説します。

LSTMとは

LSTMとは、「Long Short-Term Memory(長・短期記憶)」の略称で、RNN(リカレントニューラルネットワーク)を改良したモデルです。

RNNは、過去の情報を保持しながら時系列データを処理できる特徴を持っています。

例えば、

- 文章

- 音声

- 動画

- 株価

- センサーデータ

などの「順番」が重要なデータを扱うことが可能です。

しかし通常のRNNでは、系列が長くなると古い情報を保持しづらくなる問題がありました。

LSTMは、この問題を解決するために開発されました。

なぜLSTMが必要だったのか

RNNの「勾配消失問題」

通常のRNNでは、誤差逆伝播によって過去へ情報を伝えながら学習します。

しかし、系列が長くなると勾配が徐々に小さくなり、古い情報を学習できなくなることがあります。

現在 ← 過去 ← 過去 ← 過去

勾配 小 極小 ほぼ0これを「勾配消失問題」と呼びます。

例えば長文処理では、文頭の情報を文末で利用しづらくなります。

重み衝突問題

時系列データでは、

- 今すぐ重要な情報

- 将来的に重要な情報

が混在しています。

通常のRNNでは、同じ重みを使い続けるため、異なる時間スケールの情報を適切に扱いにくい問題がありました。

これを「重み衝突」と呼びます。

LSTMの基本構造

LSTMは、「LSTMユニット」と呼ばれる特殊な構造で構成されます。

主な要素は以下の4つです。

- 記憶セル(Cell State)

- 入力ゲート

- 忘却ゲート

- 出力ゲート

これらを組み合わせることで、「記憶する」「忘れる」を制御します。

記憶セルとは

LSTMの中心となるのが「記憶セル」です。

これは長期記憶を保存する領域であり、重要情報を長期間保持できます。

通常のRNNでは情報が徐々に薄れてしまいますが、LSTMではセル状態を維持することで長距離依存関係を扱いやすくしています。

LSTMの3つのゲート

忘却ゲート

不要な情報を削除する役割です。

例えば古い文脈が不要になった場合、その情報を忘れます。

入力ゲート

新しい情報をどれだけ記憶するかを決定します。

重要な情報のみを記憶セルへ保存します。

出力ゲート

現在の記憶状態から、どの情報を出力するかを制御します。

LSTMのイメージ

LSTMは、以下のような「情報管理システム」に近い構造です。

入力情報

↓

[忘却ゲート] → 不要情報を削除

↓

[入力ゲート] → 新情報を保存

↓

[記憶セル] → 長期記憶保持

↓

[出力ゲート] → 必要情報を出力この仕組みによって、長期的な文脈を維持できます。

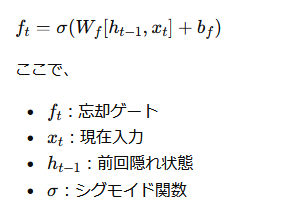

LSTMの基本的な数式

LSTMでは複数のゲート計算が行われます。

代表的な忘却ゲートの式は以下です。

を表します。

シグモイド関数によって「どれくらい忘れるか」を0〜1で制御しています。

LSTMの活用例

自然言語処理

LSTMは文章の長期文脈を保持できるため、自然言語処理で大きく活躍しました。

代表例:

- 機械翻訳

- 文章生成

- 要約

- チャットボット

音声認識

音声は時間的な流れを持つため、LSTMとの相性が良い分野です。

時系列予測

過去データの流れを学習しながら未来予測を行えます。

例:

- 株価予測

- 需要予測

- 気象予測

- IoTセンサーデータ解析

GRUとの違い

LSTMは高性能ですが、構造が複雑という欠点があります。

そこで開発されたのが、GRU です。

GRUは、

- ゲート数削減

- パラメータ削減

- 高速学習

を実現しています。

LSTMとGRUの比較

| 項目 | LSTM | GRU |

|---|---|---|

| 構造 | 複雑 | シンプル |

| パラメータ数 | 多い | 少ない |

| 学習コスト | 高い | 比較的低い |

| 長期記憶性能 | 高い | やや簡略化 |

| 学習速度 | 遅め | 速め |

用途によって使い分けられます。

Transformer時代との関係

現在の自然言語処理では、Transformer が主流です。

Transformerは、

- 並列処理可能

- 長距離依存に強い

- 学習速度が速い

という特徴を持っています。

現在の

- GPT

- BERT

などもTransformerベースです。

それでもLSTMが重要な理由

現在でもLSTMは多くの分野で利用されています。

特に、

- 小規模データ

- リアルタイム処理

- 時系列予測

- 組み込みAI

などでは依然として有効です。

また、時系列AIを学ぶ基礎としても非常に重要です。

まとめ

LSTM(Long Short-Term Memory)は、RNNの勾配消失問題や重み衝突問題を改善するために開発された時系列ニューラルネットワークです。

特徴的なのは、

- 記憶セル

- 入力ゲート

- 忘却ゲート

- 出力ゲート

によって情報を柔軟に管理できる点です。

これにより、

- 長期文脈保持

- 時系列解析

- 自然言語理解

などが大幅に向上しました。

現在はTransformerが主流となっていますが、LSTMは現代AI発展の重要な基盤技術であり、深層学習を理解するうえで欠かせない存在です。

こちらもご覧ください:エルマンネットワーク(Elman Network)とは?RNNの文脈理解を支えた仕組みをわかりやすく解説