自然言語処理や音声認識など、時系列データを扱うAI技術では「RNN(リカレントニューラルネットワーク)」が長年利用されてきました。

その中でも、文脈理解をさらに強化するために登場したのが 双方向RNN(Bidirectional Recurrent Neural Network:BiRNN) です。

通常のRNNは「過去から未来」への情報しか利用できません。しかし双方向RNNでは、「未来から過去」の情報も同時に利用することで、より高度な文脈理解を実現しています。

この記事では、双方向RNNの仕組みや特徴、通常のRNNとの違い、活用事例、注意点まで分かりやすく解説します。

双方向RNN(BiRNN)とは

双方向RNN(BiRNN)は、時系列データを「前方向」と「後方向」の両方から処理するニューラルネットワークです。

通常のRNNでは、データを過去から未来へ順番に処理します。

例えば文章なら、

私は → 昨日 → 映画を → 見たのように左から右へ情報を伝播させます。

一方、双方向RNNでは、

- 過去 → 未来

- 未来 → 過去

という2方向のネットワークを同時に利用します。

これにより、ある単語を「前後両方の文脈」から理解できるようになります。

通常のRNNとの違い

単方向RNNの特徴

通常のRNNでは、現在の出力は「過去の情報」のみを参考にします。

例えば、

彼は銀行へ行ったという文章があった場合、「銀行」という単語の意味は前の単語から推測します。

しかし実際には、後続の文章によって意味が変わるケースもあります。

双方向RNNの特徴

双方向RNNでは、未来側の情報も考慮できます。

つまり、

- 前にある単語

- 後ろにある単語

の両方を使って単語の意味を判断します。

例えば次の文を考えてみましょう。

彼は川の銀行に座ったここでは「銀行」は金融機関ではなく、「川岸」を意味している可能性があります。

双方向RNNは後続の文脈まで確認できるため、単語の意味をより正確に理解できます。

双方向RNNの仕組み

双方向RNNは、2つの独立したRNNを組み合わせた構造になっています。

前方向ネットワーク

通常通り、

過去 → 未来へ情報を伝播します。

後方向ネットワーク

逆方向に、

未来 → 過去へ情報を伝播します。

出力を統合する

最終的には、

- 前方向RNNの出力

- 後方向RNNの出力

を結合して最終結果を計算します。

イメージとしては次のようになります。

→ → → →

← ← ← ←この2方向の情報を統合することで、より豊富な文脈表現を実現します。

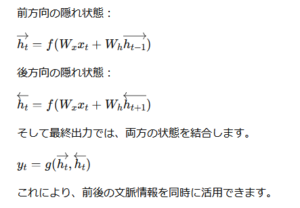

双方向RNNの数式イメージ

双方向RNNでは、前方向と後方向で別々の隠れ状態を持ちます。

双方向RNNが活躍する分野

自然言語処理(NLP)

双方向RNNは、文章理解との相性が非常に良いモデルです。

代表例としては、

- 機械翻訳

- 文章分類

- 感情分析

- 固有表現抽出

- 文章要約

などがあります。

特に単語の意味を前後関係から理解するタスクで効果を発揮します。

音声認識

音声データでも、後続の音が前の音の意味に影響することがあります。

双方向RNNを使うことで、音声全体の流れを考慮した認識が可能になります。

医療・センサーデータ解析

時系列データ全体を参照できるため、

- 心電図解析

- 異常検知

- IoTデータ分析

などにも利用されています。

双方向RNNのメリット

文脈理解能力が高い

最大のメリットは、前後両方の情報を利用できることです。

これにより、

- 単語の意味解釈

- 文脈理解

- 長距離依存関係の把握

が向上します。

精度向上につながりやすい

単方向RNNよりも多くの情報を利用できるため、多くの自然言語処理タスクで精度向上が期待できます。

双方向RNNのデメリット

リアルタイム処理が苦手

双方向RNNは「未来のデータ」を必要とします。

つまり、文章全体や音声全体が揃っていないと処理できません。

そのため、

- リアルタイム翻訳

- ライブ音声認識

- ストリーミング処理

には不向きな場合があります。

計算コストが増える

RNNを2つ動かすため、

- メモリ使用量

- 学習時間

- 計算量

が増加します。

双方向RNNとLSTM・GRUの関係

実際の深層学習では、単純なRNNよりも、

- BiLSTM(双方向LSTM)

- BiGRU(双方向GRU)

が多く利用されます。

理由は、通常のRNNでは勾配消失問題が発生しやすいためです。

LSTMやGRUはゲート機構を持ち、長期依存関係をより安定して学習できます。

現在でも多くの自然言語処理モデルでBiLSTMは利用されています。

Transformer時代の双方向性との関係

現在のAIではTransformerが主流ですが、「双方向性」という考え方は現在も重要です。

例えばBERTでは、

- 左文脈

- 右文脈

を同時に利用して単語を理解しています。

これは双方向RNNの思想と非常に近い考え方です。

つまり、BiRNNは現在の大規模言語モデルにもつながる重要な基礎技術といえます。

まとめ

双方向RNN(BiRNN)は、時系列データを前後両方向から処理するニューラルネットワークです。

通常のRNNでは過去の情報しか利用できませんでしたが、BiRNNでは未来側の情報も活用することで、より高度な文脈理解が可能になりました。

ポイントを整理すると、以下の通りです。

- 前後両方向の文脈を利用できる

- 自然言語処理との相性が良い

- 文脈理解精度が向上しやすい

- リアルタイム処理には不向き

- 実務ではBiLSTMやBiGRUがよく使われる

双方向RNNは、現在のTransformer系モデルを理解するうえでも重要な基礎知識です。

AIや自然言語処理を学ぶなら、ぜひ押さえておきたい技術の一つです。

こちらもご覧ください:BPTT(Backpropagation Through Time)とは?RNN学習の仕組みをわかりやすく解説