時系列データを扱うAIモデルである「RNN(リカレントニューラルネットワーク)」を学ぶうえで欠かせない技術が、**BPTT(Backpropagation Through Time)**です。

BPTTは、RNNが文章や音声のような連続データを学習する際に利用される学習アルゴリズムであり、現在の深層学習の基礎技術の一つとして広く知られています。

しかし、BPTTは通常のニューラルネットワークの学習とは少し仕組みが異なるため、初心者には理解しづらい部分もあります。

この記事では、BPTTの基本概念から、RNNとの関係、勾配消失問題、Truncated BPTT、LSTMとの関係まで、わかりやすく解説します。

BPTT(Backpropagation Through Time)とは

BPTTとは、「時間方向に誤差逆伝播を行う学習手法」です。

日本語では「時間方向の誤差逆伝播法」とも呼ばれます。

通常のニューラルネットワークでは、入力から出力まで誤差を逆方向へ伝えながら学習を行います。

BPTTは、この誤差逆伝播を「時系列方向」に拡張したものです。

なぜRNNではBPTTが必要なのか

RNNの特徴

RNN(Recurrent Neural Network)は、過去の情報を保持しながら処理できるニューラルネットワークです。

例えば以下のような分野で活用されています。

- 機械翻訳

- 音声認識

- 文章生成

- 株価予測

- センサーデータ分析

RNNの特徴は、前の時刻の出力を次の入力へ利用する「ループ構造」を持つことです。

つまり、現在の出力は過去の情報の影響を受けています。

通常の誤差逆伝播では対応できない

一般的なニューラルネットワークでは、各層が一方向につながっています。

しかしRNNにはループがあります。

そのため、

- 現在の出力

- 1つ前の状態

- さらに前の状態

が複雑につながっています。

このままでは通常の誤差逆伝播法を適用できません。

そこで考え出されたのがBPTTです。

BPTTの仕組み

RNNを時間方向に展開する

BPTTでは、RNNを時間ごとに「展開」して考えます。

例えば、

- 時刻t=1

- 時刻t=2

- 時刻t=3

のように、各時刻のネットワークを別々に並べます。

すると、一見ループしていたRNNが、非常に深い通常のニューラルネットワークのように見えるようになります。

イメージとしては次のようになります。

x1 → h1 → h2 → h3 → y

↑ ↑ ↑

t1 t2 t3この展開されたネットワーク全体に対して、誤差を後ろから前へ伝播させます。

同じパラメータを共有する

BPTTの大きな特徴として、各時刻のネットワークは「同じ重み」を共有しています。

つまり、

- t=1の重み

- t=2の重み

- t=3の重み

は別物ではありません。

同じパラメータを時間方向で繰り返し利用しています。

これにより、時系列データのパターンを効率的に学習できます。

BPTTの学習の流れ

BPTTの基本的な流れは以下の通りです。

1. 順伝播

入力データを時系列順に処理します。

例えば文章なら、

- 「私は」

- 「昨日」

- 「映画を」

- 「見た」

のように順番に処理します。

2. 損失を計算

モデルの予測結果と正解データとの差を計算します。

これが「損失(Loss)」です。

3. 時間方向へ逆伝播

現在の誤差を過去へ向かって伝播させます。

BPTTでは、未来の誤差が過去の状態にも影響します。

つまり、

- 今の予測ミス

- 数ステップ前の処理

にも責任があると考えて学習を行います。

BPTTで発生する問題

BPTTは非常に強力ですが、大きな課題があります。

それが、

- 勾配消失

- 勾配爆発

です。

勾配消失問題

誤差を長い時間方向へ伝えると、勾配がどんどん小さくなります。

例えば、

0.9 × 0.9 × 0.9 × …のように値が減少し続け、最終的にはほぼ0になります。

すると、

- 昔の情報を学習できない

- 長期依存関係を理解できない

という問題が起きます。

勾配爆発問題

逆に、勾配が異常に大きくなる場合もあります。

1.5 × 1.5 × 1.5 × …のように値が急激に増加すると、学習が不安定になります。

結果として、

- 重みが極端に更新される

- 学習が発散する

といった問題が発生します。

Truncated BPTTとは

これらの問題を軽減するために利用されるのが、**Truncated BPTT(切り詰めBPTT)**です。

これは、誤差逆伝播を「一定の過去まで」で止める手法です。

例えば、

- 最新から5ステップまで

- 最新から10ステップまで

のように、逆伝播する範囲を制限します。

Truncated BPTTのメリット

計算コストを削減できる

長い系列をすべて展開すると、計算量が非常に大きくなります。

Truncated BPTTでは計算量を抑えられます。

勾配消失を軽減できる

過去へ遡る距離が短くなるため、勾配が極端に小さくなりにくくなります。

LSTMやGRUとの関係

BPTTの課題を根本的に改善するために登場したのが、

- LSTM(Long Short-Term Memory)

- GRU(Gated Recurrent Unit)

です。

これらは「ゲート機構」を導入することで、情報の流れを制御しています。

LSTMの特徴

LSTMでは、

- 入力ゲート

- 忘却ゲート

- 出力ゲート

を利用して、必要な情報だけを長期間保持します。

特に「CEC(Constant Error Carousel)」という構造によって、勾配消失問題を大幅に改善しています。

GRUの特徴

GRUはLSTMを簡略化した構造です。

- パラメータ数が少ない

- 計算が高速

- 比較的扱いやすい

という特徴があります。

BPTTは現在でも重要なのか

現在ではTransformer系モデルが主流になっています。

しかし、BPTTは依然として重要な基礎技術です。

理由としては、

- RNN系モデルの理解に不可欠

- 時系列学習の基本概念を学べる

- 勾配問題の理解につながる

などがあります。

特に深層学習を体系的に学ぶ場合、BPTTの理解は避けて通れません。

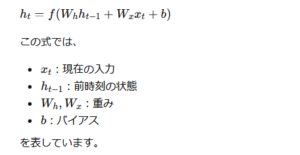

BPTTのイメージを数式で理解する

RNNでは、現在の隠れ状態は前の状態を利用して計算されます。

代表的な式は次の通りです。

BPTTでは、この関係を時間方向へ展開し、誤差を逆向きに伝播させます。

まとめ

BPTT(Backpropagation Through Time)は、RNNを学習させるための重要なアルゴリズムです。

RNNのループ構造を時間方向に展開し、誤差を過去へ伝播させることで、時系列データの学習を可能にしています。

重要なポイントを整理すると、以下の通りです。

- BPTTは時間方向の誤差逆伝播

- RNNの学習に不可欠

- 長期系列では勾配消失・勾配爆発が起きやすい

- Truncated BPTTで計算負荷を軽減できる

- LSTMやGRUはBPTTの弱点を改善したモデル

AIや深層学習を本格的に理解したい方にとって、BPTTは非常に重要な基礎知識です。

こちらもご覧ください:CEC(Constant Error Carousel)とは?LSTMが長期記憶を可能にした重要技術をわかりやすく解説