AI・機械学習の分野では、単純に「正解ラベルを当てる」だけでなく、「データ同士の似ている・似ていない」を学習する技術が重要になっています。

たとえば、

- 顔認証

- 類似画像検索

- 音声認識

- レコメンドシステム

- 自己教師あり学習

などでは、「特徴の距離」を適切に学習することが高精度化につながります。

その中核技術の一つが「Triplet Loss(トリプレットロス)」です。

Triplet Lossは、3つのデータを同時に利用しながら、「似たデータは近く、異なるデータは遠く」配置される特徴空間を学習する損失関数です。

本記事では、Triplet Lossの基本的な仕組みから、マージンやハードネガティブの重要性、実際の活用例までをわかりやすく解説します。

Triplet Lossとは?

Triplet Lossとは、データ間の「距離関係」を学習するための損失関数です。

一般的な分類モデルでは、

- 「猫」

- 「犬」

- 「車」

のようにカテゴリを直接予測します。

一方、Triplet Lossでは、

- どのデータが似ているか

- どのデータが異なるか

を学習します。

そのため、検索・認証・類似判定などのタスクと非常に相性が良い特徴があります。

なぜ「Triplet(3つ組)」なのか?

Triplet Lossでは、3つのサンプルを1セットとして学習します。

使用するのは以下の3種類です。

Anchor(アンカー)

基準となるサンプルです。

たとえば、

- 基準人物の顔画像

- 基準商品の画像

などが該当します。

Positive(ポジティブ)

アンカーと同じクラスに属するデータです。

例:

- 同じ人物の別角度画像

- 同じ商品の別写真

などがあります。

Negative(ネガティブ)

アンカーとは異なるクラスに属するデータです。

例:

- 別人の顔

- 異なる商品の画像

などが利用されます。

Triplet Lossの目的

Triplet Lossでは、以下の状態を目指して学習します。

- アンカーとポジティブ → 近づける

- アンカーとネガティブ → 遠ざける

つまり、「同じもの同士は近く、違うもの同士は離れる」ような特徴空間を作ることが目的です。

埋め込み空間(Embedding Space)とは?

Triplet Lossを理解するうえで重要なのが「埋め込み空間」です。

これは、画像や文章などを数値ベクトルへ変換した特徴空間を指します。

AIモデルは、この空間上でデータ同士の位置関係を学習します。

顔認証でのイメージ

顔認証AIでは、

- 同一人物 → 近い位置

- 別人 → 遠い位置

になるように学習されます。

その結果、新しい画像が入力されても、「距離の近さ」によって本人確認が可能になります。

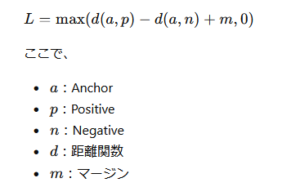

Triplet Lossの数式イメージ

Triplet Lossでは、アンカーとポジティブの距離が、アンカーとネガティブの距離より十分小さくなるよう学習します。

を表します。

マージン(Margin)とは?

Triplet Lossでは、「マージン」が重要な役割を持ちます。

マージンとは、「ネガティブが、ポジティブより最低限どれだけ遠くあるべきか」を示す閾値です。

なぜマージンが必要なのか?

もし制限なくネガティブを遠ざけようとすると、

- 学習が不安定になる

- 埋め込み空間が崩れる

- 不要な計算が増える

などの問題が起こります。

そのため、「十分離れていれば、それ以上は無理に遠ざけない」という仕組みが採用されています。

ハードネガティブ(Hard Negative)の重要性

Triplet Lossでは、「どのネガティブサンプルを選ぶか」が非常に重要です。

特に重要なのが「ハードネガティブ」です。

ハードネガティブとは?

アンカーによく似ているが、実際には異なるデータのことです。

たとえば顔認証なら、

- 双子

- 顔立ちが似た人物

- 同じ照明条件の別人

などが該当します。

なぜ重要なのか?

もしネガティブサンプルが簡単すぎると、

- 最初から十分遠い

- 損失がすぐゼロになる

ため、モデルがほとんど学習しなくなります。

つまり、「AIが間違えやすい難しい負例」をどれだけ適切に用意できるかが、学習品質を大きく左右します。

Hard Negative Miningとは?

効率的に学習するため、「Hard Negative Mining(ハードネガティブマイニング)」という技術も使われます。

これは、

- 距離が近い負例

- モデルが誤認しやすい負例

を優先的に選択する方法です。

高精度な顔認証システムでは非常に重要な技術となっています。

Triplet Lossの活用例

顔認証

Triplet Lossの代表的な用途です。

特に、Google が開発したFaceNetでは、Triplet Lossによって高精度な顔認識を実現しました。

スマートフォンの顔認証などにも応用されています。

類似画像検索

ECサイトでは、

- 似た服

- 類似家具

- 同系統の商品

などを検索するために利用されています。

画像同士の距離を比較することで、類似商品を高速に検索できます。

音声認識・話者認証

「誰が話しているか」を識別する話者認証でも活用されています。

声の特徴を埋め込みベクトルとして学習することで、高精度な認証が可能になります。

自己教師あり学習

近年は自己教師あり学習でも注目されています。

ラベルが少ない環境でも、

- データ間の関係性

- 類似構造

を学習しやすいため、大規模AI開発との相性が良い技術です。

Contrastive Lossとの違い

Triplet Lossは、Contrastive Lossと比較されることが多くあります。

Contrastive Loss

- 2つのデータを利用

- 「似ている / 異なる」を学習

Triplet Loss

- 3つのデータを利用

- 「どちらがより近いか」を学習

Triplet Lossは、相対的な距離関係をより柔軟に学習できる特徴があります。

Triplet Lossの課題

データ設計が難しい

性能は、

- アンカー選択

- ポジティブ選択

- ネガティブ選択

に大きく依存します。

特にハードネガティブの品質が重要です。

計算コストが高い

Tripletの組み合わせ数は非常に多いため、

- 学習時間

- GPUメモリ

- バッチ設計

などへの負荷が大きくなります。

そのため、大規模学習では効率化技術が不可欠です。

まとめ

Triplet Loss(トリプレットロス)とは、3つのデータを使って「似たものは近く、異なるものは遠く」学習する損失関数です。

主に、

- 顔認証

- 類似画像検索

- 音声認識

- 自己教師あり学習

などで活用されています。

また、Triplet Lossでは「ハードネガティブ」の選定が非常に重要であり、モデル性能を大きく左右します。

近年のAIでは、単純な分類だけでなく、「データ同士の関係性」を理解する能力が重要視されており、Triplet Lossはその基盤技術の一つとして広く利用されています。

こちらもご覧ください:Contrastive Lossとは?類似データを学習するAI技術をわかりやすく解説