AIの時系列データ処理でよく利用される「LSTM(Long Short-Term Memory)」には、長期的な情報を保持するための重要な仕組みがあります。

その中心となるのが CEC(Constant Error Carousel) です。

CECは、従来のRNN(リカレントニューラルネットワーク)が抱えていた「勾配消失問題」を改善するために導入された仕組みであり、現在の自然言語処理や音声認識などにも大きな影響を与えています。

この記事では、CECの役割や必要性、LSTMとの関係について、初心者にも分かりやすく解説します。

CEC(Constant Error Carousel)とは

CEC(Constant Error Carousel)は、LSTM内部に存在する「誤差を長期間維持するための構造」です。

RNNでは、時系列データを処理する際に、過去の情報を現在の計算へ引き継ぎます。

しかし、時間方向に誤差逆伝播(Backpropagation Through Time)を行うと、誤差が徐々に小さくなってしまう問題がありました。

これが有名な「勾配消失問題」です。

CECは、この問題を解決するために設計されました。

なぜRNNでは勾配消失が起こるのか

RNNは、文章や音声のような「順番に意味があるデータ」を扱うニューラルネットワークです。

例えば次のような処理があります。

- 文章の翻訳

- 音声認識

- 株価予測

- センサーデータ分析

RNNでは、過去の情報を次の時刻へ渡し続けます。しかし、長い系列になると問題が発生します。

誤差がどんどん小さくなる

誤差逆伝播では、各時刻で勾配を掛け合わせながら過去へ戻っていきます。

すると、

- 0.9 × 0.9 × 0.9 …

- 0.5 × 0.5 × 0.5 …

のように値が急激に小さくなり、最終的にはほぼ0になってしまいます。

これにより、

- 昔の情報を学習できない

- 長期依存関係を理解できない

- 文脈を保持できない

という問題が起きます。

例えば、

「昨日買った本はとても面白かった。それを友人にも薦めた。」

という文章では、「それ」が何を指すのかを理解するには、かなり前の「本」という情報を保持する必要があります。

従来のRNNは、このような長期的な文脈保持が苦手でした。

CECの役割

CECは、LSTM内部にある「セル状態(Cell State)」を通じて、誤差を減衰させずに伝える仕組みです。

LSTMでは、内部メモリに相当するセルが存在します。

CECの特徴は次の通りです。

- 自己結合の重みが1に固定されている

- 誤差が減衰しにくい

- 長期間情報を保持できる

イメージとしては、「情報専用の高速道路」のようなものです。

通常のRNNでは、情報が何度も変換されるうちに弱まります。

しかしCECでは、重要な情報をほぼそのまま未来へ運ぶことができます。

CECの仕組みを数式で理解する

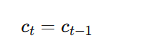

CECでは、セル状態が時間方向へ維持されます。

代表的なイメージは次のようになります。

これは「前の時刻のセル状態を、そのまま次へ渡す」という考え方を表しています。

通常のニューラルネットワークでは、重みの掛け算によって値が変化しますが、CECでは自己結合の重みが1で固定されているため、誤差が極端に小さくなりにくいのが特徴です。

その結果、

- 昔の情報を維持できる

- 長文の依存関係を学習できる

- 安定した学習が可能になる

というメリットが得られます。

CECだけでは不十分な理由

CECは非常に強力ですが、問題もあります。

それは「情報を保持し続けてしまう」ことです。

不要な情報まで残り続けると、逆に学習効率が悪化します。

例えば、

- 既に不要になった単語情報

- 古い文脈

- ノイズデータ

などまで記憶してしまう可能性があります。

そこでLSTMでは、CECの周囲に「ゲート機構」を配置しています。

LSTMの3つのゲート機構

LSTMでは、CECを制御するために3種類のゲートが用意されています。

入力ゲート(Input Gate)

新しい情報を記憶するかどうかを決定します。

必要な情報だけをセルへ取り込みます。

忘却ゲート(Forget Gate)

不要になった情報を削除します。

LSTMが長期間安定して動作できる理由の一つです。

特に重要なのがこの忘却ゲートで、これによって「必要な記憶だけを残す」ことが可能になりました。

出力ゲート(Output Gate)

セル状態のうち、どの情報を外部へ出力するかを制御します。

内部メモリ全体をそのまま出すのではなく、必要な情報だけを利用できます。

CECが重要視される理由

CECの登場によって、RNN系モデルは長期依存問題を大幅に改善できるようになりました。

特に以下の分野で大きな成果を上げています。

自然言語処理(NLP)

- 機械翻訳

- 文章生成

- 要約

- チャットボット

長い文章でも文脈を維持しやすくなりました。

音声認識

音声は時間的連続性が強いため、過去の情報保持が非常に重要です。

CECによって長時間の音声解析が安定しました。

時系列予測

- 株価予測

- 需要予測

- IoTセンサーデータ解析

などでもLSTMが活用されています。

Transformer時代でもCECは学ぶ価値がある

現在はTransformer系モデルが主流になっていますが、CECやLSTMの考え方は依然として重要です。

理由は以下の通りです。

- AIの時系列処理の基礎理解につながる

- 「記憶」の概念を学べる

- ゲート制御の思想が他モデルにも応用されている

特にAI初学者にとっては、「なぜLSTMが必要だったのか」を理解するうえで、CECは非常に重要な概念です。

まとめ

CEC(Constant Error Carousel)は、LSTM内部で誤差を安定して伝播させるための重要な仕組みです。

従来のRNNが苦手としていた「長期記憶」を可能にし、自然言語処理や音声認識の発展を支えました。

CECのポイントを整理すると次の通りです。

- 勾配消失問題を緩和する

- セル状態を長期間維持できる

- 誤差を減衰させずに伝播できる

- ゲート機構と組み合わせて効率的な記憶管理を行う

現在のAI技術を深く理解するためにも、CECとLSTMの仕組みは押さえておきたい重要テーマです。